Añadir sensores 3D a los dispositivos móviles dará lugar a juegos de realidad aumentada, escaneado 3D portátil y mejores fotografías.

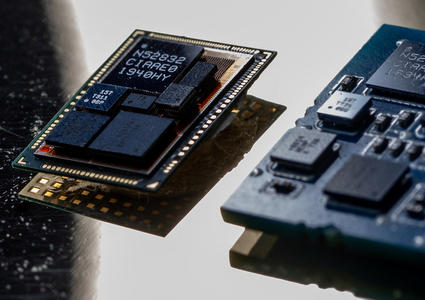

Foto: Se puede usar una tableta para escanear un objeto en 3D usando Structure Sensor y otro hardware nuevo que está llegando a los dispositivos móviles.

Foto: Se puede usar una tableta para escanear un objeto en 3D usando Structure Sensor y otro hardware nuevo que está llegando a los dispositivos móviles.

Una década después de que aparecieran las primeras cámaras en los teléfonos móviles, estos dispositivos son unos de los más utilizados en dichos teléfonos y mantienen a empresas tremendamente populares y valiosas, como Instagram y Snapchat. Ahora, un nuevo hardware que permite a los ordenadores portátiles tener visión 3D puede abrir una nueva dimensión para las aplicaciones de imágenes y permitir nuevas formas de usar los dispositivos móviles. Las primeras aplicaciones capaces de escanear en mundo en 3D muestran potencial para crear nuevas formas de jugar, comerciar y sacar fotografías.

La primera tecnología de sensores de profundidad que llegue al mercado probablemente será Structure Sensor, un accesorio para el iPad de Apple que da al dispositivo capacidades parecidas a las del controlador de juegos de Microsoft, el Kinect. Occipital, la empresa de San Francisco (EEUU) que hay detrás del hardware afirma que los primeros envíos de su producto se harán en febrero de 2014. Una campaña de Kickstarter para fabricar el dispositivo ya ha recaudado unos 553.000 euros cuando aún falta un mes para que concluya.

Occipital ha desarrollado aplicaciones que permiten escanear objetos en 3D caminando alrededor de ellos, así como habitaciones enteras. Una de ellas muestra cómo el sensor puede servir para crear una realidad aumentada, en la que imágenes virtuales se superponen al mundo real cuando se mira a través de un visor. Con esa aplicación, se puede jugar a lanzar una pelota a un gato que rebota al chocar con objetos reales (ver vídeo).

El director ejecutivo y cofundador de Occipital Jeff Powers afirma que ahora se está centrando en que creadores de software generen aplicaciones atractivas basadas en sensores 3D. Quienes están interesados en comprar el Structure Sensor, lo están en gran medida por las aplicaciones para jugar, y en usarlo para escanear objetos para ayudar a copiar y diseñar objetos para su impresión en 3D. "Mucha gente nos está preguntando si pueden usarlo para medir espacios, para sustituir los métodos que se usan en la construcción actualmente", afirma Powers.

Structure Sensor proyecta un patrón moteado de luz infrarroja a través del cual su cámara registra cómo distorsionan ese patrón los objetos sobre los que se posa. Es esa información la que se usa para reconstruir objetos en 3D. El proceso depende de un chip que Occipital compra a PrimeSense (Israel), que hace el hardware subyacente en la Kinect de Microsoft, y que tiene su propio proyecto para llevar los sensores de profundidad a los dispositivos móviles. En enero de este año, PrimeSense hizo una demostración de un sensor 3D llamado Capri que es lo suficientemente pequeño para los portátiles y las tabletas (ver "Los fabricantes de PC apuestan por el gesto, la mirada, la voz y el tacto"); este mes, el fabricante de chips Qualcomm lo ha usado para presentar un juego de realidad aumentada en una tableta con sistema operativo Android.

El juego usa el sensor Capri para capturar la forma en 3D de una mesa y cualquier objeto que tenga encima. Después, construye un mundo virtual de orcos guerreros, barrancos de piedra y torres. "Los personajes del juego pueden navegar alrededor de los objetos físicos y chocar y saltar sobre ellos", afirma el vicepresidente de gestión de producto en Qualcomm Jay Wright. Una persona que juegue con dicha aplicación podría tocar la pantalla de la tableta para interactuar con ese mundo y caminar por el mundo real para conseguir una nueva perspectiva del virtual (ver video).

La aplicación se creó añadiendo soporte para detección 3D al software Vuforia de Qualcomm, que ayuda a los creadores de software móvil a construir aplicaciones de realidad aumentada, una característica que la empresa denomina Smart Terrain. No obstante, Wright predice que los consumidores acabarán usando las aplicaciones capaces de ver en profundidad para algo más que jugar. Por ejemplo, se podría usar una aplicación con Smart Terrain para ver una visión previa virtual de un nuevo mueble en tu salón a escala real.

Qualcomm pondrá Smart Terrain a disposición de los creadores de aplicaciones a principios del año que viene, pero Wright no ofrece ninguna pista sobre cuándo podrían aparecer los primeros dispositivos con la detección de profundidad necesaria para usarlo. Sin embargo, el director tecnológico y cofundador de Pelican Imaging, una start-up de California (EEUU) Kartik Venkataraman, afirma que tendrá lugar en pocos años.

La empresa de Venkataraman ha desarrollado un sensor de cámara de detección de profundidad que tiene el mismo tamaño que la mayoría de las cámaras que se usan en los dispositivos móviles actuales. Venkataraman explica: "Tenemos un diseño de referencia y estamos hablando con fabricantes de teléfonos interesados en llevar esto al mercado en un teléfono o algún tipo de dispositivo móvil".

La tecnología de Pelican usa una serie de 16 cámaras diminutas para registrar el "campo de luz" que hay delante de un dispositivo, recogiendo no solo el color y la localización de los haces de luz como hace una cámara 2D, sino también la dirección de la que proceden (ver "Fotografía de campo de luz"). Un campo de luz se puede usar para reconstruir imágenes en estéreo de una escena para inferir la profundidad, y el sensor de Pelican es capaz de capturar el tamaño de los objetos con precisión a unos 50 centímetros, afirma Venkataraman.

Pelican investiga los mismos usos de realidad aumentada y escaneo que Occipital y Qualcomm. Sin embargo, dado que estas ideas aún están muy lejos de los usos que da la gente a los dispositivos móviles en la actualidad, es probable que el trabajo de Venkataraman sobre el uso de la detección de profundidad para potenciar la fotografía móvil ya existente sea el que primero despegue.

"Instagram aplica filtros a toda la escena, mientras que la nuestra permite aplicar filtros a distintas capas de la escena", afirma Venkataraman, y añade: "Eso tiene el potencial de crear filtros mucho más interesantes".

La aplicación de demostración de Pelican puede hacer que toda una foto aparezca en blanco y negro salvo la persona en la imagen, por ejemplo. La misma aplicación puede usar datos de detección de profundidad para recortar con precisión a alguien de una imagen para recolocarlo o cortarlo y pegarlo en otra escena.