Las empresas y las instituciones tienen la posibilidad de analizar cada vez más información sobre nuestras vidas y resulta tentador responder con nuevas leyes y mecanismos que generen ingresos por nuestros datos. Pero lo que necesitamos es una solución cívica, porque está en juego la democracia.

En 1967, la revista trimestral The Public Interest, uno de los principales foros de debate político de alto nivel en aquel momento, publicó un provocativo ensayo de Paul Baran, uno de los padres del método de transmisión de datos conocido como conmutación de paquetes, titulado “The Future Computer Utility” (Los servicios de computación del futuro). El ensayo especulaba con la idea de que algún día unos cuantos grandes ordenadores centralizados proporcionarían "servicios de procesado de información [...] igual que las compañías eléctricas venden electricidad ahora mismo".

"Nuestro ordenador doméstico se usará para enviar y recibir mensajes, como telegramas. Podremos usarlo para ver si los grandes almacenes locales tienen la camisa deportiva del anuncio en el almacén, en el color y la talla que queremos. Podremos preguntar si la entrega está garantizada en caso de compra. La información estará actualizada al minuto y será fiable. Podremos pagar nuestras facturas y hacer nuestros impuestos a través de la consola. Haremos preguntas y recibiremos respuestas de "bancos de información", versiones automatizadas de las bibliotecas actuales. Obtendremos un listado actualizado de todos los programas de radio y televisión [...]. El ordenador podrá enviarnos, él solo, un mensaje para que nos acordemos de un cumpleaños próximo y nos ahorremos las desastrosas consecuencias del olvido."

La computación en nube ha tardado décadas en cumplir la visión de Baran. Pero fue lo suficientemente profético como para preocuparse de que este tipo de computación iba a necesitar su propio modelo regulador. Era un empleado de la RAND Corporation -que no era precisamente un refugio de ideas marxistas- preocupado por la concentración del poder del mercado en las manos de grandes empresas de servicios de computación y solicitaba la intervención del Estado. Baran también quería políticas que "ofrecieran la máxima protección para conservar los derechos a la privacidad de la información".

"La información personal o empresarial importante y muy sensible se almacenará en muchos de los sistemas que contemplamos [...]. De momento, sólo la confianza -o como mucho la falta de sofisticación técnica- se interponen en el camino de un posible fisgón [...]. Hoy en día no contamos con mecanismos que aseguren una protección adecuada. Dada la dificultad de reconstruir sistemas complejos para incorporar dichas protecciones en el futuro, parece deseable anticiparse a esos problemas."

Un análisis incisivo y sin miramientos: el tecnofuturismo ha estado en declive desde entonces.

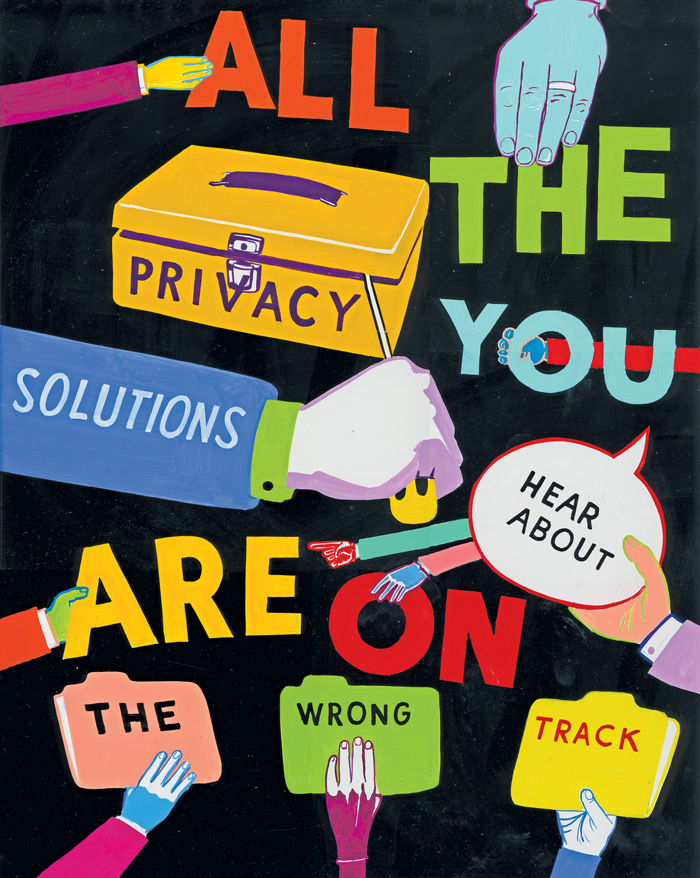

Todas las soluciones que se han planteado desde entonces respecto a la privacidad van por el camino equivocado

Al leer el ensayo de Baran (sólo uno de entre los numerosos que se publicaron sobre los servicios de computación en la época), uno se da cuenta de que nuestro problema contemporáneo con la privacidad no es contemporáneo. No es sólo consecuencia de que Mark Zuckerberg haya vendido su alma y nuestros perfiles a la Agencia de Seguridad Nacional (NSA por sus siglas en inglés). El problema se reconoció hace mucho tiempo y se hizo muy poco por resolverlo.

Casi todos los usos imaginados por Baran para los "servicios de computación" son puramente comerciales. Comprar camisas, pagar recibos, buscar entretenimiento, conquistar el olvido. No es el internet de las "comunidades virtuales" y los "ciudadanos en red". Baran simplemente imaginó que la computación en red nos permitiría hacer cosas que ya hacemos sin ella: compras, entretenimiento, investigación. Pero también: espionaje, vigilancia y voyeurismo.

Si la "revolución informática" de Baran no suena demasiado revolucionaria, se debe en parte a que él no imaginó que pudiera cambiar radicalmente los cimientos del capitalismo y la administración burocrática instalados desde hace siglos. Para la década de 1990, sin embargo, muchos entusiastas de lo digital pensaban de otra forma; estaban convencidos de que la difusión de las redes digitales y el rápido abaratamiento de los costes de comunicación representaban una fase auténticamente nueva del desarrollo humano. Para ellos, la vigilancia que se disparó en la década del 2000 a partir de los atentados del 11 de septiembre, y la colonización de estos inmaculados espacios digitales por parte de Google, Facebook, así como los grandes volúmenes de datos eran aberraciones a las que nos podríamos resistir o, al menos, dar marcha atrás. ¡Ojalá pudiéramos borrar esa década que perdimos y volver a la utopía de las décadas de 1980 y 1990, aprobando leyes más estrictas, dando un mayor control a los usuarios y construyendo mejores herramientas de encriptado!

Una lectura diferente de la historia reciente daría lugar a una agenda distinta para el futuro. La sensación generalizada de la emancipación a través de la información que muchos siguen atribuyendo a finales del siglo XX, probablemente fuera una alucinación prolongada. Tanto el capitalismo como la administración burocrática se acomodaron fácilmente al nuevo régimen digital; ambos prosperan muy bien con los flujos de información, cuanto más automatizados, mejor. Ni las leyes, ni los mercados ni las tecnologías obstaculizarán o reconducirán la demanda de datos, puesto que, de entrada, los tres tienen un papel en el mantenimiento del capitalismo y la administración burocrática. Hace falta otra cosa: política.

Incluso los programas aparentemente inocuos pueden socavar la democracia

Empecemos por enumerar los síntomas de nuestra enfermedad actual. Sí, los intereses comerciales de las empresas tecnológicas y los interesas políticos de las agencias gubernamentales han convergido: a ambas les interesa la recolección y el análisis rápido de datos de usuarios. Google y Facebook se ven obligados a recoger cada vez más datos para mejorar la eficacia de los anuncios que venden. Las agencias de los gobiernos necesitan esos mismos datos -que pueden recoger ellas mismas o en colaboración con las empresas tecnológicas- para llevar a cabo sus propios programas.

Muchos de esos programas tienen que ver con la seguridad nacional. Pero estos datos se pueden usar de otras formas que también afectan a la privacidad. El Gobierno italiano, por ejemplo, está usando una herramienta llamada "redditometro", o medidor de ingresos, que analiza las facturas y patrones de gasto para marcar a quienes gastan más de sus ingresos declarados como posibles defraudadores fiscales. Una vez que los pagos móviles sustituyan a un porcentaje importante de las transacciones en efectivo -con Google y Facebook como intermediarios- los datos recogidos por estas empresas serán indispensables para Hacienda. De forma parecida, los académicos del derecho están ocupados explorando cómo usar el minado de datos para elaborar contratos o testamentos a la medida de la personalidad, las características y el comportamiento pasado de ciudadanos individuales, mejorando la eficiencia y reduciendo las malas prácticas.

En otro frente, los tecnócratas como el antiguo administrador de la Oficina de Información y Regulación de la Casa Blanca, Cass Sunstein, uno de los principales defensores de un "estado niñera" que empuje a los ciudadanos a hacer determinadas cosas, esperan que la recogida y el análisis instantáneo de datos sobre los individuos sirva para resolver problemas como la obesidad, el cambio climático y la conducción temeraria, mediante la redirección de nuestro comportamiento. Un nuevo libro de tres académicos británicos —Changing Behaviours: On the Rise of the Psychological State (Cambiando comportamientos: el auge del estado psicológico)— enumera una larga lista de planes de este tipo ya en funcionamiento en el Reino Unido, donde la unidad de "empujoncitos" del Gobierno ha tenido tanto éxito que está a punto de convertirse en una operación con ánimo de lucro.

Gracias a los smartphones y Google Glass, ahora se puede contactar con nosotros siempre que estemos a punto de hacer alguna estupidez, maldad o insensatez. No haría falta que supiéramos necesariamente por qué la acción está mal: los algoritmos del sistema hacen el cálculo moral por sí mismos. Los ciudadanos adoptan el papel de máquinas de información que alimentan el complejo tecnobrurocrático con sus datos. Y ¿por qué no íbamos a hacerlo si nos prometen cinturas más finas, un aire más limpio y vidas más largas (y seguras) a cambio?

Esta lógica de la prevención no es muy distinta de la de la NSA en su lucha contra el terror: mejor prevenir los problemas que lidiar con sus consecuencias. Incluso aunque atemos las manos a la NSA -con una combinación de mejores sistemas de vigilancia, leyes más estrictas sobre el acceso a los datos, o tecnologías de encriptado más potentes y fáciles de usar- el ansia por obtener datos de otras instituciones estatales seguirá existiendo. La justificarán. En temas como la obesidad o el cambio climático -sobre los que los legisladores no pierden tiempo en apostillar que nos enfrentamos a un escenario a punto de explotar- afirmarán que un pequeño déficit de democracia podría ser de gran ayuda.

Este sería el aspecto de ese déficit: la nueva infraestructura digital, que se nutre de los datos en tiempo real proporcionados por los ciudadanos, permite a los tecnócratas sacar a la política, con todo su ruido, fricción y descontento, del proceso político. Sustituye a la farragosa labor de creación de coaliciones, negociaciones y deliberaciones por una pulcra y eficiente administración alimentada de datos.

Este fenómeno tiene un nombre que se podría convertir en meme: “regulación algorítmica”, como la denomina el editor de Silicon Valley, Tim O'Reilly. En esencia, las democracias ricas en información han alcanzado un punto en el que quieren intentar resolver los problemas públicos sin tener que dar explicaciones o justificarse ante los ciudadanos. Pueden limitarse a decir que es en nuestro propio interés, y saben lo suficiente sobre nosotros para diseñar un empujoncito perfecto, altamente personalizado e irresistible.

La privacidad es un medio para la democracia, no un fin en sí misma

Otro aviso del pasado. Corría el año 1985 y Spiros Simitis, el principal estudioso y practicante de la privacidad en Alemania -en aquel momento era el comisario de protección de datos del estado de Hesse- daba una conferencia ante la Facultad de Derecho de la Universidad de Pennsylvania (EEUU). Su discurso exploraba exactamente el mismo tema que preocupaba a Baran: la automatización del procesado de datos. Pero Simitis no perdía de vista la historia del capitalismo y la democracia, así que veía los cambios tecnológicos bajo una luz mucho más ambigua.

También reconocía que la privacidad no es un fin en sí misma. Es un medio para conseguir determinado ideal de política democrática en la que se confía en que los ciudadanos sean más que proveedores acríticos de información a tecnócratas que todo lo ven y todo lo optimizan. "Cuando se desmantela la privacidad", avisaba Simitis, "tanto la oportunidad de evaluar el proceso político por uno mismo, como la oportunidad de desarrollar y mantener un estilo de vida concreto se desvanecen".

En el análisis de Simitis subyacían tres tendencias tecnológicas. Para empezar, incluso entonces se dio cuenta de que todas las esferas de interacción social estaban mediadas por la tecnología de la información -avisó de "la recuperación intensiva de datos personales de virtualmente cada empleado, contribuyente, paciente, cliente de banco, receptor de ayudas sociales o conductor". En consecuencia, la privacidad ya no era sólo un problema de algún desgraciado pillado con la guardia baja en una situación extraña; se había convertido en el problema de todos. En segundo lugar, las nuevas tecnologías, como las tarjetas inteligentes y el videotexto no sólo permitían "registrar y reconstruir actividades individuales al minuto", sino que estaban normalizando la vigilancia, entretejiéndola con nuestra cotidianeidad. En tercer lugar, la información personal registrada por estas nuevas tecnologías permitía a las instituciones sociales poner en práctica estándares de comportamiento, disparando "estrategias de manipulación a largo plazo con la intención de modelar y adaptar la conducta individual".

Las instituciones modernas tenían mucho que ganar con todo esto. Las aseguradoras podían hacer programas de ahorro a la medida de las necesidades y exigencias de pacientes, hospitales y la industria farmacéutica. La policía podía usar las nuevas bases de datos disponibles y distintos "perfiles de movilidad" para identificar delincuentes potenciales y localizar a sospechosos. De repente, las agencias de servicios sociales podían descubrir comportamientos fraudulentos.

Pero, ¿cómo nos afectarían estas tecnologías como ciudadanos, como sujetos que participan en la comprensión y reforma del mundo que nos rodea, no sólo como consumidores o clientes que simplemente se benefician de ellas?

Caso tras caso, Simitis argumentaba que no teníamos más que perder. En vez de tener un mayor contexto para la toma de decisiones, tendríamos menos; en vez de poder ver la lógica que sostiene nuestros sistemas burocráticos, y hacer que esa lógica sea más precisa y menos kafkiana, tendríamos una mayor confusión porque la toma de decisiones empezaba a ser automatizada y nadie sabía exactamente cómo funcionaban los algoritmos. Percibiríamos una imagen más borrosa de cómo funcionan nuestras instituciones sociales; a pesar de la promesa de una mayor personalización y de tener más poder en nuestras manos, los sistemas interactivos solo nos proporcionarían una ilusión de mayor participación. En consecuencia "los sistemas interactivos [...] sugieren actividad individual donde, de hecho, sólo tienen lugar reacciones estereotipadas".

Si crees que Simitis describía un futuro que nunca llegó a suceder, piensa en un artículo reciente sobre la transparencia de los sistemas de predicción automatizados escrito por uno de los expertos mundiales en la política y la ética del minado de datos, Tal Zarsky. Zarsky señala que "el minado de datos puede destacar a individuos y hechos, indicando un riesgo elevado, sin decirnos por qué se seleccionaron". Resulta que el grado de interpretabilidad es una de las decisiones políticas más relevantes a la hora de diseñar sistemas de minado de datos. Zarsky entiende que esto tiene importantes implicaciones para la democracia:

"El análisis de minado de datos puede dar lugar a un proceso no interpretable que no se puede explicar en lenguaje humano. En este caso, el software toma sus decisiones de selección basándose en múltiples variables (miles, incluso) [...]. Sería difícil que un gobierno pudiera dar una respuesta detallada cuando se le preguntase por qué un individuo ha sido escogido para recibir un tratamiento diferenciado por un sistema de recomendación automático. Lo máximo que podría decir el gobierno, es que el algoritmo decide basándose en casos anteriores."

Este es el futuro en el que estamos entrando con los ojos cerrados. Todo parece funcionar y puede, incluso, que las cosas sean mejores, pero es que no sabemos exactamente por qué o cómo.

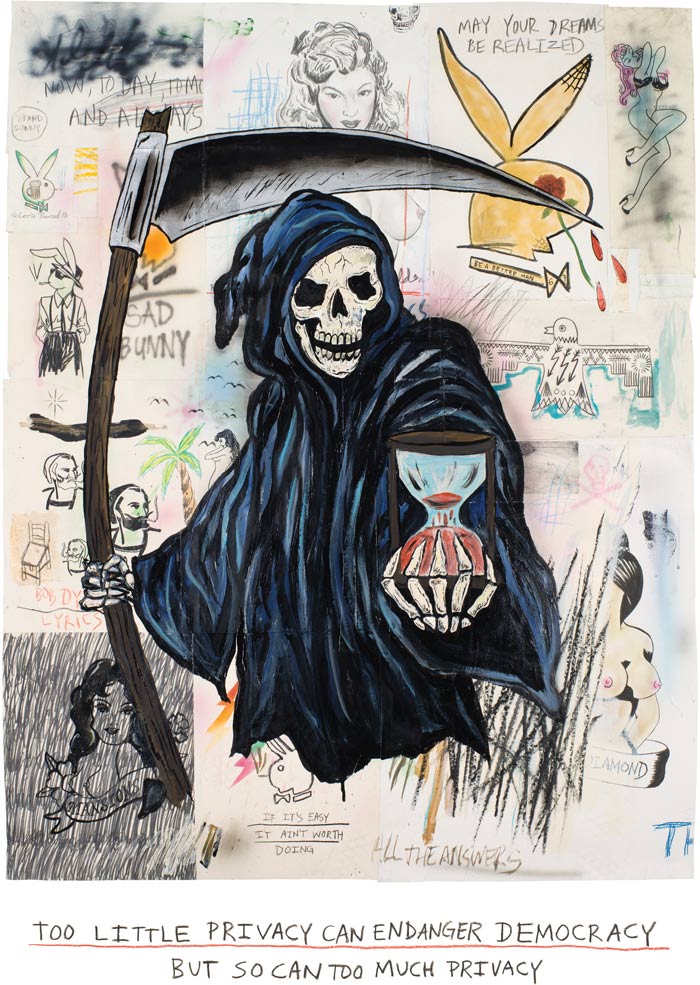

La falta de privacidad puede poner en peligro la democracia. Pero también el exceso.

Simitis acertó con las tendencias. Libre de sospechosas hipótesis sobre "la era de internet", llegó a una defensa original pero prudente de la privacidad como característica vital para una democracia autocrítica; no la democracia de alguna teoría política abstracta, sino la democracia ruidosa y liosa que habitamos, con sus interminables contradicciones. En concreto, la idea clave de Simitis es que la privacidad tiene la capacidad tanto de sostener como de socavar la democracia.

Tradicionalmente, nuestra respuesta a los cambios en el procesado de la información automatizada ha sido considerarlos como un problema personal de los individuos afectados. Valga como ejemplo el artículo seminal “The Right to Privacy” (El derecho a la privacidad), de Louis Brandeis y Samuel Warren. Escrito en 1890, buscaban un "derecho a ser dejado en paz" para vivir una vida sin interrupciones, alejado de los intrusos. Según Simitis, expresaban un deseo, común a muchos de los individuos hechos a sí mismos de la época, "de disfrutar en exclusiva y bajo condiciones decididas por ellos, los frutos de su actividad económica y social".

Un objetivo loable: sin extender esta protección legal a los emprendedores, el capitalismo estadounidense moderno quizá nunca hubiera llegado a ser tan robusto. Pero este derecho, desconectado de cualquier responsabilidad correspondiente, también podía servir para aprobar un aislamiento excesivo que nos escude del mundo externo y socave los cimientos del propio régimen democrático que posibilita este derecho. Si todos los ciudadanos ejercieran de forma completa su derecho a la privacidad, la sociedad se vería depravada de los datos transparentes y fácilmente disponibles, necesarios no sólo por el bien de los tecnócratas, sino -en mayor medida aún- para que los ciudadanos puedan evaluar temas, formar sus opiniones y debatir (y, de vez en cuando, despedir a los tecnócratas).

Este problema no es exclusivo del derecho a la privacidad. Para algunos pensadores contemporáneos, como el historiador y filósofo francés Marcel Gauchet, las democracias corren el riesgo de convertirse en víctimas de su éxito: habiendo instaurado un régimen legal de derechos que permite a los ciudadanos seguir sus intereses privados sin ninguna referencia sobre lo que es bueno para el bien común, pueden estar agotando los mismos recursos que las han permitido florecer.

Cuando todos los ciudadanos exigen sus derechos pero no son conscientes de sus responsabilidades, las preguntas políticas que han definido la vida democrática desde hace siglos; ¿cómo deberíamos vivir juntos? ¿qué se hace por el bien común y cómo lo equilibrio con mis propios intereses? se incluyen en el dominio de lo legal, lo económico y lo administrativo. "Lo político" y "lo público" ya no se registran siquiera como dominios; las leyes, los mercados y las tecnologías sustituyen al debate y la contestación como soluciones preferibles, menos engorrosas.

Pero una democracia en la que los ciudadanos no participan, no suena demasiado a democracia y puede que no sobreviva como una. Algo evidente para Thomas Jefferson, quien, aunque quería que todos los ciudadanos “fueran partícipes del gobierno de los asuntos”, también creía que la participación cívica implica una tensión constante entre la vida pública y la privada. Una sociedad que cree, como describe Simitis, que el acceso de los ciudadanos a la información "acaba donde empieza la exigencia burguesa de privacidad", no durará como una democracia con un buen funcionamiento.

Así, es necesario ajustar el equilibrio entre privacidad y transparencia con mucho más cuidado en momentos de rápidos cambios tecnológicos. Ese equilibrio ya es un tema político por excelencia en sí mismo, a resolver mediante el debate público y a dejar siempre abierto a la negociación. No se puede dejar resuelto, de una vez por todas, a través de una combinación de teorías, mercados y tecnologías. Como dijo Simitis: "lejos de considerarse un elemento constitutivo de una sociedad democrática, la privacidad aparece como una contradicción tolerada, cuyas implicaciones deben reconsiderarse continuamente".

Las leyes y los mecanismos de mercado no son solución suficiente.

En las últimas décadas, según hemos ido generando más datos, nuestras instituciones se han hecho adictas a ellos. No está claro que pudieran sobrevivir en caso de que retuviéramos los datos y cortásemos los bucles de retroalimentación. Nosotros, como ciudadanos, estamos atrapados en una situación extraña: nuestros motivos para proporcionar los datos no son que nos preocupa profundamente el bien común. No, proporcionamos datos por motivos egoístas, en Google o a través de aplicaciones de autoseguimiento. Somos demasiado cutres como para no usar servicios gratuitos subvencionados por la publicidad. O queremos seguir nuestro plan de ejercicio y nuestra dieta, y después vendemos los datos.

Ya en 1985, Simitis sabía que esto conduciría inevitablemente a la "regulación algorítmica" que está cogiendo forma en la actualidad, con la política convirtiéndose en "administración pública" que va con el piloto automático para que los ciudadanos puedan relajarse y disfrutar, sólo para recibir un empujoncito de vez en cuando, cuando se les olvida comprar brócoli.

Las costumbres, actividades y preferencias se recopilan, registran y utilizan para mejorar la adaptación del individuo, no su capacidad de actuar y decidir. Cualquiera que fuese el incentivo original para la informatización, el procesado tiene visos cada vez mayores de ser el medio ideal para adaptar a un individuo a un comportamiento predeterminado y estándar cuyo objetivo es lograr el máximo grado de cumplimiento posible del paciente, consumidor, contribuyente o ciudadano modelo.

Lo que describe Simitis es la construcción de lo que yo denomino "alambre de espino invisible" en torno a nuestras vidas intelectuales y sociales. Los grandes volúmenes de información, que dependen de numerosas bases de datos interconectadas que se alimentan de información y algoritmos de dudoso origen, imponen graves restricciones sobre cómo maduramos política y socialmente. El filósofo alemán Jürgen Habermas tenía razón al advertir -en 1963- de que "una civilización exclusivamente técnica [...] se ve amenazada [...] por la división de los seres humanos en dos clases: los ingenieros sociales y los residentes de instituciones sociales cerradas".

El alambre de espino invisible del big data limita nuestras vidas a un espacio que podría parecer tranquilo y lo suficientemente atractivo, pero ni lo hemos elegido nosotros, ni podemos reconstruirlo ni ampliarlo. Lo peor es que no lo vemos así. Como creemos que somos libres de ir donde queramos, el alambre de espino sigue siendo invisible. Aún más: no hay a quién echarle la culpa. Ni a Google, ni a Dick Cheney, ni a la NSA. Es el resultado de muchas lógicas y sistemas diferentes -del capitalismo moderno, del gobierno burócrata, de la gestión de riesgos- que se alimentan de la automatización del procesado de la información y de la despolitización de la política.

Cuanta más información revelemos sobre nosotros mismos, más denso pero más invisible es este alambre de espino. Vamos perdiendo nuestra capacidad de razonar y debatir poco a poco; ya no entendemos por qué nos suceden las cosas.

Pero no todo está perdido. Podríamos aprender a darnos cuenta de que estamos atrapados en este alambre de espino, e incluso a cortarlo. La privacidad es el recurso que nos permite hacerlo y, con un poco de suerte, incluso ayudarnos a planificar nuestra ruta de huida.

Es en este punto donde Simitis expresó una idea auténticamente revolucionaria que se ha perdido en los debates contemporáneos sobre la privacidad: no se puede lograr ningún progreso, afirmó, mientras la protección de la privacidad se "equipare, más o menos, con el derecho del individuo a decidir cuándo y qué datos son accesibles". La trampa en la que caen muchos defensores bienintencionados de la privacidad es creer que con que pudieran dar al individuo un mayor control sobre sus datos -mediante leyes más fuertes o un régimen de propiedad robusto- el alambre de espino invisible se volvería visible y se rompería. No lo hará, no si esos datos se acaban devolviendo a las propias instituciones que erigen el alambre a nuestro alrededor.

Piensa en la privacidad en términos éticos.

Si aceptamos la privacidad como un problema de y para la democracia, entonces las soluciones populares son inadecuadas. Por ejemplo, en su libro Who Owns the Future? (¿De quién es el futuro?), Jaron Lanier propone que descartemos un pilar de la privacidad, el legal, y nos centremos en el económico. "Los derechos comerciales están mejor adaptados a la multitud de pequeñas situaciones curiosas que surgirán en la vida real que una nueva clase de derechos civiles en la línea de la privacidad digital", escribe. Siguiendo esta lógica, si convertimos nuestros datos en un bien que podemos vender, logramos dos cosas. Primero podemos controlar quién tiene acceso a ellos y, en segundo lugar, podemos compensar algunas de las pérdidas económicas producidas por la ruptura con todo lo analógico.

La propuesta de Lanier no es original. En Code and Other Laws of Cyberspace (El código y otras leyes del ciberespacio, cuya primera edición e inglés es de 1999), Lawrence Lessig habla con entusiasmo de construir un régimen de propiedad en torno a los datos privados. Lessig quería un "mayordomo electrónico" capaz de negociar con los sitios web: "El usuario establece sus preferencias una vez, especificando cómo negociaría con su privacidad y a qué está dispuesto a renunciar. Sólo en el caso de que las máquinas se pongan de acuerdo, el sitio podrá acceder a sus datos personales".

No cuesta ver dónde nos llevaría este razonamiento. Todos tendríamos aplicaciones de smartphone personalizadas que incorporarían continuamente la última información sobre la gente que conocemos, los sitios que visitamos y la información que poseemos, para poder actualizar el precio de nuestra cartera de datos personales. Sería muy dinámico: una lujosa joyería, quizá quiera pagar más para conocer la fecha de cumpleaños de tu pareja si estás pasando por delante de su fachada que si estás sentado en casa viendo la tele.

Es cierto que el régimen de propiedad puede fortalecer la privacidad: si los consumidores quieren recibir buenos ingresos por su cartera de datos, tienen que asegurarse de que sus datos no estén ya disponibles en otros sitios. Así, o bien los "alquilan" de la misma forma que Netflix alquila películas, o los venden con la condición de que se puedan usar o revender sólo bajo condiciones muy estrictas. Algunas empresas ya ofrecen "taquillas de datos" para facilitar intercambios seguros de este tipo.

Entonces, si lo que quieres es defender el "derecho a la privacidad" en sí mismo, convertir los datos en una mercancía podría resolver tus dudas. La NSA seguiría teniendo lo que quiere; pero si te preocupa que nuestra información privada es demasiado líquida y hemos perdido el control sobre su movimiento, un modelo de negocios inteligente emparejado con un régimen de gestión de derechos digitales potente podría resolverlo.

Mientras, las instituciones dedicadas a ejercer de "gobierno niñera" también querrán estos datos. Quizá estén dispuestas pagar una pequeña cantidad o a prometer una rebaja fiscal por el privilegio de darte los consabidos "empujoncitos" más adelante, con la ayuda de los datos de tu smartphone. Ganan los consumidores, ganan los emprendedores, ganan los tecnócratas. La privacidad, ya sea de una forma u otra, también queda protegida. ¿Quién pierde entonces? Si has estudiado tu Simitis, ya conoces la respuesta: la democracia.

Y no es sólo porque el alambre de espino invisible seguiría en su sitio. También deberían preocuparnos las implicaciones para la justicia y la igualdad. Por ejemplo, mi decisión de proporcionar información personal, aunque sólo sea a mi aseguradora, inevitablemente tendrá implicaciones para otras personas, muchas de ellas con menos medios. La gente que dice que hacer un seguimiento de su estado de salud o su localización sólo es una elección afirmativa a la que pueden renunciar, sabe muy poco sobre cómo piensan las instituciones. Una vez que haya una masa crítica suficiente de personas que se hagan autoseguimiento -y la mayoría de ellos probablemente obtengan algo a cambio- a quienes se nieguen ya no se les verá como individuos raritos que ejercen su autonomía. No, se les considerará desviados que tienen algo que ocultar. Su seguro médico será más caro. Si no perdemos de vista este hecho, nuestra decisión de autoseguirnos no será tan sencilla de reducir a un interés económico egoísta; en algún punto, pueden entrar en juego consideraciones morales. ¿De veras quiero compartir mis datos y conseguir un cupón que no necesito, si eso significa que otra persona que ya está pluriempleada por necesidad tenga que acabar pagando más? Este tipo de preocupaciones morales son irrelevantes si delegamos la toma de decisiones en manos de "mayordomos electrónicos".

Pocos hemos tenidos dudas morales sobre los programas para compartir datos, pero eso podría cambiar. Antes de que el medio ambiente fuera una preocupación global, pocos nos tomábamos en serio la idea de coger el transporte público si podíamos conducir. Antes de que el consumo ético se convirtiera en una preocupación global, nadie habría pagado más por un café que sabe igual pero es de comercio justo. Pensemos en una camiseta barata en una tienda. Quizá sea completamente legal comprarla, pero después de décadas de duro trabajo por parte de los activistas, una etiqueta que pone "Made in Bangladesh" nos hace detenernos antes de comprar. Quizá temamos que esté hecha por niños o adultos explotados. O, habiéndolo pensado, quizá queramos comprar la camiseta porque esperamos que sirva para mantener el trabajo de un niño que de otra forma se vería obligado a prostituirse. ¿Qué es lo correcto en este caso? No lo sabemos, así que investigamos un poco. Este tipo de escrutinio no se puede aplicar a todo lo que compramos, o nunca saldríamos de la tienda. Pero los intercambios de información -el oxígeno de la vida democrática- deberían entrar en la categoría de "pensar más, no menos". No es algo que se pueda delegar en manos de un "mayordomo electrónico", no si no queremos eliminar la dimensión política de nuestra vida.

Sabotea el sistema. Provoca más preguntas

También debería preocuparnos la sugerencia de que podemos reducir el problema de la privacidad a su dimensión legal. La pregunta que nos hemos estado haciendo a lo largo de las dos últimas décadas -¿Cómo podemos asegurarnos de tener un mayor control sobre nuestra información personal?- no puede ser la única que nos hagamos. A menos que aprendamos y continuamente reaprendamos cómo promueve e impide la vida democrática la información automatizada, las respuestas a esta pregunta podrían ser inútiles, sobre todo si el régimen democrático necesario para ejercitar cualesquiera que sean, se descompone mientras tanto.

Intelectualmente, al menos, está claro lo que hay que hacer: enfrentarse a la pregunta, no sólo en sus dimensiones económica y legal, sino también en una dimensión política, ligando el futuro de la privacidad al futuro de la democracia, rechazando reducir la cuestión de la privacidad a un asunto de los mercados o de las leyes. ¿Qué significa esta idea filosófica en la práctica?

Para empezar, debemos politizar el debate en torno a la privacidad y a compartir información. Articular la existencia -y las profundas consecuencias políticas- del alambre de espino invisible sería un buen principio. Debemos examinar detenidamente las formas de resolución de problemas que hacen un uso intensivo de los datos y sacar a la luz el hecho de que en ocasiones tienen un carácter antidemocrático. A veces, debemos aceptar mayores riesgos, imperfecciones, improvisación, e ineficacia para mantener vivo el espíritu democrático.

En segundo lugar, debemos aprender a sabotear el sistema, quizá negándonos a hacer autoseguimiento. Si negarnos a registrar nuestro consumo calórico o nuestra localización es la única forma de conseguir que los legisladores aborden las causas estructurales de problemas como la obesidad o el cambio climático -y no sólo juguetear con sus síntomas a través de pequeños empujoncitos al ciudadano- los boicots de información quizá estén justificados. Negarse a obtener dinero de tus propios datos puede ser un acto tan político como negarse a conducir un coche o a comer carne. La privacidad podría resurgir entonces como un instrumento político para mantener el espíritu democrático vivo: queremos espacios privados porque seguimos creyendo en nuestra capacidad para reflexionar sobre los males del mundo y de encontrar una forma de arreglarlos, y preferimos no entregar esta capacidad a los algoritmos y los bucles de retroalimentación.

En tercer lugar, necesitamos más servicios digitales provocativos. No es suficiente que un sitio web nos anime a decidir quién debe ver nuestros datos, sino que debería despertar nuestra propia imaginación. Bien diseñados, los sitios no conducirían a los ciudadanos ni a guardar celosamente su información privada ni a compartirla, sino que revelarían las dimensiones políticas ocultas que conllevan los distintos actos de compartir información. No queremos un mayordomo electrónico, queremos un provocador electrónico. En vez de la enésima aplicación para decirnos cuánto dinero podemos ahorrar siguiendo nuestra rutina de ejercicio, necesitamos una aplicación que nos diga cuánta gente es probable que pierda su seguro médico si la industria de las aseguradoras tiene los mismos datos que la NSA, la mayoría, aportados por consumidores como nosotros. Con el tiempo, quizá distingamos esas dimensiones solos, sin ayudas tecnológicas.

Por último, tenemos que abandonar ideas preconcebidas sobre cómo funcionan y se interconectan nuestros servicios digitales. Si no, seremos víctimas de la misma lógica que ha constreñido la imaginación de tantísimos defensores de la privacidad bienintencionados que creen que defender el "derecho a la privacidad" -no luchar para conservar la democracia- es lo que debería mover la política pública. Aunque muchos activistas de internet defenderán lo contrario, lo que le suceda a internet tiene una importancia secundaria. Igual que con la privacidad, nuestro objetivo principal debería ser el destino de la propia democracia.

Después de todo, en 1967 Paul Baran no tuvo la suerte de saber en qué se convertiría internet. Eso no le impidió ver los posibles beneficios y los peligros de los servicios de computación. Abandona la idea de que internet cayó en desgracia lo largo de la última década. Liberarnos de esa malinterpretación de la historia podría ayudarnos a abordar las amenazas antidemocráticas del futuro digital.

Evgeny Morozov es el autor de The Net Delusion: The Dark Side of Internet Freedom y To Save Everything, Click Here: The Folly of Technological Solutionism.