Dado que las compañías tecnológicas desempeñaban un papel cada vez más importante en el seguimiento y la deportación de inmigrantes por parte del Gobie o de Estados Unidos, le pedían que "defendiera los derechos civiles y las libertades civiles". Y añadieron: "Tal y como se advirtió, Rekognition es un poderoso sistema de vigilancia fácilmente disponible para violar derechos y atacar a las comunidades de color".

nJunto con la carta, la Unión Americana de Libertades Civiles (ACLU, por sus siglas en inglés) de Washington (EE. UU.) entregó más de 150.000 firmas y una segunda carta de los propios accionistas de la compañía en la que expresaban exigencias parecidas. Unos días más tarde, los empleados de Amazon se hicieron eco de estas preocupaciones en un memorando inte o.

nA pesar de la creciente presión, parece que Bezos hizo oídos sordos. En lugar de limitar Rekognition, lo impulsó a como herramienta para monitorizar a las "personas de interés" y duplicó el suministro de otras tecnologías de vigilancia a los gobie os. Por ejemplo, la filial de la compañía Ring, adquirida solo unos meses antes, rápidamente se asoció con más de 1.300 organismos policiales para usar las grabaciones de las cámaras de seguridad de los hogares en las investigaciones criminales.

nPero el miércoles 10 de junio de este año, Amazon sorprendió a los investigadores y activistas de los derechos civiles al comunicar que aplicaría una moratoria de un año sobre el uso policial de Rekognition. La medida se sucedía al anuncio previo de IBM de que iba a abandonar su sistema de reconocimiento facial de uso general. Y, al día siguiente, Microsoft se sumó al movimiento cuando hizo público que dejaría de vender su sistema a los departamentos de policía hasta que la ley federal regule esta tecnología.

nAunque la concesión de Amazon es la más limitada de las tres, la compañía es el mayor proveedor de tecnología para la policía. Esta decisión es la culminación de los últimos dos años de investigación y presión exte a para demostrar los defectos técnicos de Rekognition y sus posibilidades de abuso.

n"Parece increíble que Amazon de verdad esté respondiendo al actual debate sobre el racismo. Es una demostración de lo poderoso que resulta el momento actual", opina la investigadora de las responsabilidades de inteligencia artificial (IA) y coautora de un estudio fundamental sobre sesgos y errores raciales presentes en la tecnología de esta empresa, Deborah Raji.

n"Un año es un comienzo. Representa un reconocimiento absoluto por parte de la compañía, al menos implícito, de que lo que los defensores de la justicia racial llevan dos años asegurando es correcto: la tecnología de vigilancia y reconocimiento facial pone en peligro a las personas de raza negra y de origen latino. Se trata de una aceptación extraordinaria", destaca la directora del programa de Libertad Tecnológica de la ACLU de Massachusetts (EE. UU.), Kade Crockford.

nDos años de debate

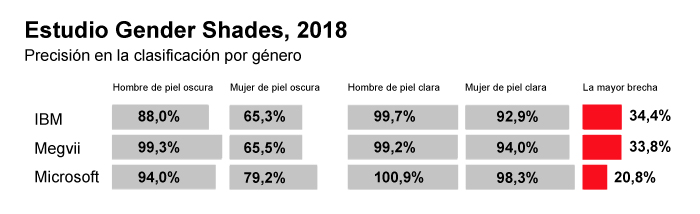

nEn febrero de 2018, la investigadora del MIT Joy Buolamwini y la entonces investigadora de Microsoft Timnit Gebru publicaron un estudio innovador bajo el título Gender Shades (Sombras de género) sobre los sesgos raciales y de género integrados en los sistemas comerciales de reconocimiento facial. El trabajo incluía los sistemas vendidos por Microsoft, IBM y Megvii, uno de los mayores proveedores de reconocimiento facial de China. Pero no incluía a Rekognition de Amazon.

n

Y, aunque se trataba del primer estudio de este tipo, los resultados fueron impactantes: el peor sistema, el de IBM, tenía 34,4 % de error en la clasificación por género para las mujeres de piel más oscura que para los hombres de piel más clara. Los hallazgos inmediatamente desmintieron las afirmaciones de precisión que las empresas habían utilizado para vender sus productos y provocaron un debate sobre el reconocimiento facial en general.

nA medida que el debate avanzaba, pronto quedó claro, además, que el problema iba mucho más allá de los datos de entrenamiento asimétricos o los algoritmos imperfectos. Incluso si los sistemas alcanzaran una presión del 100 %, aún se podrían usar de manera peligrosa, advirtieron muchos investigadores y activistas.

n

Foto: Un fotograma del vídeo de Joy Buolamwini titulado 'AI, Ain't I A Woman?' demuestra algunos de los atroces errores cometidos por Rekognition. Crédito: Cortesía de la Liga de la Justicia Algorítmica

n"Hay dos formas con las que esta tecnología puede perjudicar a las personas. Una sería cuando no funciona bien: las tasas de error más altas para las personas de color las destacan como un mayor riesgo. La segunda situación es cuando sí funciona y el sistema de reconocimiento facial resulta perfecto. En este caso es fácil convertirlo en un arma contra las comunidades para acosarlas. Se trata de dos cuestiones distintas pero relacionadas", destaca Raji, quien trabajó con Buolamwini y Gebru en Gender Shades. Y añade: "El trabajo de Gender Shades intentaba demostrar la primera situación", pero al lograrlo, abrió la puerta para revelar la segunda.

nn"Amazon trató de desacreditar su investigación; intentó desautorizarlas como mujeres negras que lideraron esta investigación". Meredith Whittaker.

n

En IBM ocurrió lo siguiente. Después de la publicación de Gender Shades, IBM fue una de las primeras empresas que contactó con las investigadoras para buscar formas de solucionar sus problemas de sesgo. En enero de 2019, lanzó un conjunto de datos denominado Diversity in Faces (Diversidad de rostros), con más de un millón de imágenes de caras etiquetadas, en un esfuerzo por mejorar dichos sistemas.

nPero la iniciativa fracasó cuando la gente descubrió que las imágenes habían sido sacadas de Flickr, lo que planteaba problemas de consentimiento y privacidad. Provocó otra serie de debates inte os sobre cómo entrenar éticamente el reconocimiento facial. "Los llevó al abismo al darse cuenta de la multitud de problemas que había con esta tecnología", explica Raji.

nAsí que, al final, no resultó tan sorprendente que la compañía finalmente decidiera abandonar la tecnología (eso sí, los críticos señalan que, realidad, su sistema tampoco no tenía mucho peso en su negocio ni en el mercado). IBM "simplemente se dio cuenta de que los 'beneficios no eran de ninguna manera proporcionales al daño'. Y el contexto social actual se convirtió en el mejor momento para hacerlo público", sostiene Raji.

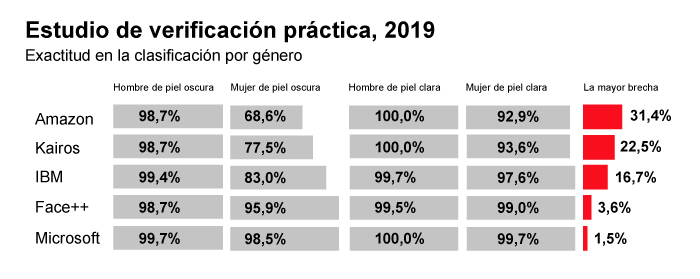

nPero mientras IBM respondía a las críticas exte as, Amazon tuvo la reacción opuesta. En junio de 2018, en medio de todas las demás cartas que exigían que la empresa detuviera el uso policial de Rekognition, Raji y Buolamwini para incluir la herramienta de Amazon. Los resultados, publicados medio año después en un artículo revisado por pares, también encontraron enormes errores técnicos. Rekognition clasificaba el género de las mujeres de piel más oscura con un 31,4 % de menos precisión que el de los hombres de piel más clara.

n

En julio, la ACLU del norte de Califo ia (EE. UU.) también realizó su propio estudio y encontró que el sistema igualaba equivocadamente las fotos de 28 miembros del Congreso de EE. UU. con fotografías de las fichas policiales. Las falsas coincidencias eran desproporcionadamente más frecuentes con personas de color.

nSin embargo, en vez de admitir los fallos, Amazon publicó dos actualizaciones de blog en las que alegaba que el trabajo de Raji y Buolamwini era engañoso. En respuesta, casi 80 investigadores de IA, incluido el ganador del Premio Turing Yoshua Bengio, defendieron su trabajo e insistieron a la compañía que dejara de vender el reconocimiento facial a la policía.

nRaji recuerda: "Fue un momento muy emocionalmente sensible. Habíamos actuado con muchísima diligencia con nuestros resultados. Y, luego, la primera respuesta fue directamente conflictiva y agresivamente defensiva". La cofundadora y directora del AI Now Institute, Meredith Whittaker, que estudia los impactos sociales de la IA, añade: "Amazon trató de desacreditar su investigación; intentó desautorizarlas como mujeres negras que lideraron esta investigación. Buscó cambiar el discurso para que pareciera que ellas se habían equivocado, que cualquiera que entendiera esta tecnología claramente sabría que esto no era un problema".

nn"La decisión puso a Amazon en una situación política realmente peligrosa ". Mutale Nkonde

n

De hecho, mientras rechazaba públicamente el estudio, de forma privada, Amazon había empezado a invertir en la búsqueda de soluciones. Contrató a un líder imparcial, concedió una subvención de investigación para la Fundación Nacional para la Ciencia (NSF) de EE. UU. para mitigar estos problemas y lanzó una nueva versión de Rekognition unos meses más tarde, para responder de forma directa a las preocupaciones del estudio, explica Raji. Pero, al mismo tiempo, rechazó los esfuerzos de los accionistas para suspender las ventas de esta tecnología y realizar una evaluación independiente basada en los derechos humanos. También gastó millones en presionar al Congreso de EE. UU. para evitar la regulación.

nPero luego todo cambió. El 25 de mayo de 2020, el policía Derek Chauvin asesinó a George Floyd, provocando un movimiento histórico en Estados Unidos para combatir el racismo institucional y poner fin a la brutalidad policial. En respuesta, los demócratas del Congreso y del Senado de EE. UU. presentaron un proyecto de ley de reforma policial que incluye una propuesta para limitar el reconocimiento facial en un contexto policial.

nEsta propuesta representa el mayor esfuerzo federal para regular la tecnología. Y cuando IBM anunció que cancelaría su sistema de reconocimiento facial, también envió una carta al grupo de congresistas negros (Caucus Negro) del Congreso de EE. UU., para pedir "un diálogo nacional sobre si resulta apropiado que la tecnología de reconocimiento facial sea utilizada por las agencias policiales nacionales y cómo".

n"Creo que la decisión de IBM de enviar esa carta, en el momento en el que el mismo cuerpo legislativo está considerando un proyecto de ley de reforma policial, realmente cambió el panorama", opina la asesora de políticas sobre inteligencia artificial y profesora del Centro Berkman Klein de la Universidad de Harvard (EE. UU.) Mutale Nkonde. "Aunque no tenían tanto peso en el reconocimiento facial, esa decisión realmente puso a Amazon en una peligrosa situación política". Estableció un vínculo claro entre la tecnología y el debate nacional en curso, de una manera difícil de ignorar por parte de los reguladores.

nFuturo incierto

nPero mientras los activistas e investigadores consideran que la concesión de Amazon es una gran victoria, también reconocen que la lucha no ha terminado. Por un lado, el comunicado de Amazon de un total de 102 palabras fue poco claro en cuanto a los detalles sobre si su moratoria abarcaría a las agencias de seguridad más allá de la policía, como el Servicio de Inmigración y Control de Aduanas de Estados Unidos o el Departamento de Seguridad Nacional de EE. UU. (Amazon no respondió a una solicitud de comentarios). Por otro lado, el período de un año también es una señal de alerta.

nCrockford señala: "Mi parte escéptica diría que Amazon va a esperar hasta que las protestas desaparezcan, hasta que el debate nacional cambie de tema, para volver a su posición anterior. Vamos a observar de cerca para asegura os de que estas empresas no reciban una buena prensa por estos recientes comunicados mientras, por detrás, trabajan para frustrar nuestros esfuerzos en los órganos legislativos".

nEs por eso que los activistas e investigadores también creen que la regulación tendrá un papel crítico en el futuro. "La lección aquí no es que las empresas deben autogobe arse", destaca Whittaker. "La lección es que se necesita más presión, y que nos hacen falta reglamentos que garanticen que no estamos ante una prohibición de solo un año".

nn"Mi parte escéptica diría que Amazon va a esperar hasta que las protestas desaparezcan, hasta que el debate nacional cambie de tema, para volver a su posición anterior". Kade Crockford

n

Los críticos aseguran que las estipulaciones sobre el reconocimiento facial en el actual proyecto de ley de la reforma policial, que solo prohíbe su uso en tiempo real en cámaras corporales, no son suficientemente amplias para exigir plenas responsabilidades a los gigantes tecnológicos. Pero Nkonde es optimista y cree que este primer conjunto de recomendaciones es una semilla para la futura regulación adicional. Una vez aprobadas y convertidas en ley, se convertirán en un importante punto de referencia para otros proyectos legislativos para prohibir el reconocimiento facial en otras aplicaciones y contextos.

nExiste "en realidad un movimiento legislativo más amplio" tanto a nivel federal como local, asegura. Y el hecho de que la muerte de Floyd haya aclarado las prácticas policiales racistas ha acelerado su amplio apoyo. Crockford concluye: "No deberían haber hecho falta los asesinatos policiales de George Floyd, Breonna Taylor y de demasiadas otras personas negras, ni que centenares de miles de personas salieran a las calles de todo el país para que estas empresas se dieran cuenta de que las exigencias de las organizaciones y expertos liderados por los negros y latinos, de la ACLU y de muchos otros grupos eran moralmente correctas. Pero aquí estamos. Más vale tarde que nunca".

n