Inteligencia Artificial

La ONG de la inteligencia artificial apuesta por enseñar a las máquinas como al perro de Pávlov

OpenAI, una organización sin ánimo de lucro centrada en los beneficios de la IA, ha lanzado una herramienta para ayudar a las máquinas a aprender mediante ensayo y error, y estímulos acordes

Parece probable que la próxima gran tendencia de la inteligencia artificial (IA) consistirá en ordenadores y robots autodidactas que aprenden mediante un sistema de ensayo y error.

Elon Musk y Sam Altman (de Y Combinator) provocaron un gran revuelo en diciembre al reclutar a varios investigadores de alto perfil para unirse a las filas de OpenAI, una organización sin ánimo de lucro de 1.000 millones de dólares (unos 881 millones de euros) dedicada a publicar investigaciones punteras en IA de forma gratuita. El miércoles la organización publicó los primeros frutos de su trabajo, y sugiere que este tipo de aprendizaje será importante para el futuro de la IA.

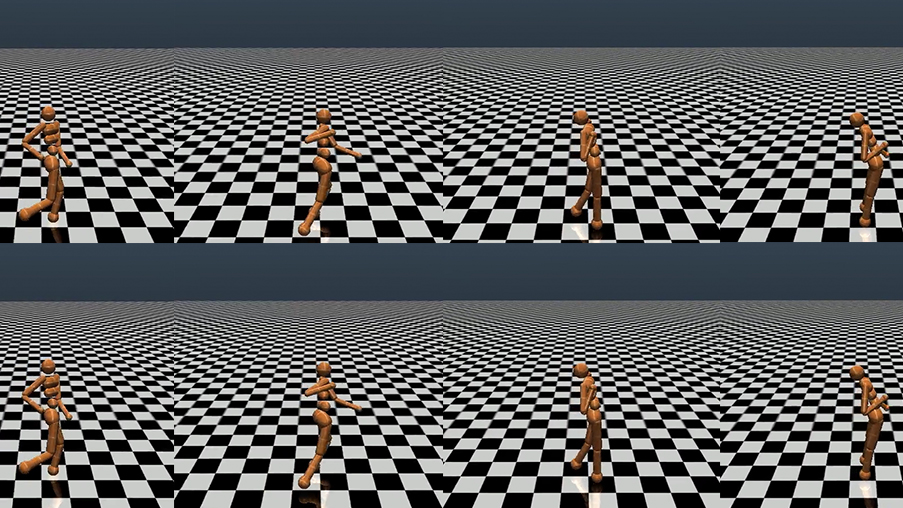

Vídeo: Un software lanzado por OpenAI puede emplearse para entrenar personajes virtuales como este humanoide, que aprende a andar. Crédito: OpenAI.

La organización sin ánimo de lucro ha lanzado una herramienta llamada OpenAI Gym para desarrollar y comparar diferentes algoritmos de aprendizaje reforzado. Esta técnica consiste en que las máquinas aprendan mediante estímulos positivos y negativos. OpenAI también ha anunciado esta semana dos contrataciones nuevas, entre las que se incluye el profesor adjunto de la Universidad de California en Berkeley (EEUU) y destacado experto en la aplicación del aprendizaje reforzado de robots, Pieter Abbeel.

OpenAI Gym incluye código y ejemplos para ayudar a su público a arrancar con el aprendizaje reforzado. Se puede, por ejemplo, generar un programa que aprenda mediante la experimentación a jugar a unos sencillos videojuegos. La nueva herramienta también permite que los usuarios suban y compartan los proyectos en los que trabajan.

El aprendizaje reforzado ya representa un área popular de las investigaciones académicas e industriales. Fue, por ejemplo, un componente de AlphaGo, el sistema que venció recientemente a uno de los mejores jugadores de Go del mundo. Y algunos fabricantes de robots ya están explorando la posibilidad de automatizar el proceso por el que las máquinas son programadas para realizar una determinada tarea.

Cuando fundaron OpenAI, Musk y Altman dijeron que el objetivo era asegurarse de que la inteligencia artificial beneficiara a todos y protegerse ante la posibilidad de unas peligrosas e inesperadas consecuencias. La verdad podría ser algo más complicada. Como señala un reciente artículo de Wired, el trabajo de OpenAI podrá publicarse más libremente que los trabajos realizados en, digamos, Google o Facebook, pero tal vez pueda beneficiar a las varias empresas que han invertido antes que nadie.

(Para saber más: Wired, El proyecto para hacer la IA más segura para la humanidad choca con el resto de sus avances, Este robot pasa la noche en vela para aprender sus tareas él solo, La ley del mínimo esfuerzo enseña tareas complejas a los robots de forma sencilla)