Aunque las causas no están claras, un algoritmo ha aprendido a analizar y categorizar los diagramas, tablas y ecuaciones de los 'papers' y ofrece un buscador de consulta gratuito y público

En 1973, el estadista Francis Anscombe publicó una fascinante demostración que mostraba por qué los datos siempre han de ser representados en gráficos antes de ser analizados. Su afirmación se basaba en cuatro conjuntos de datos con propiedades estadísticas casi idénticas. Parecían esencialmente iguales.

Pero al representarlos gráficamente, los conjuntos de datos mostraron aspectos totalmente distintos. El cuarteto de Anscombe, como ha llegado a denominarse, demuestra cómo las buenas gráficas ayudan a la gente a analizar los datos de manera distinta, y de considerarlos y hablar de ellos a otro nivel.

La mayoría de los científicos reconocen la importancia de una buena gráfica para comunicar ideas complejas. Resulta difícil de describir la estructura del ADN, por ejemplo, sin un diagrama.

Y aun así, existen pocas, si es que existen, pruebas que demuestren que las buenas gráficas representan una parte importante de los avances científicos. La importancia de unas buenas gráficas puede parecer obvia, pero sin pruebas sigue siendo tan sólo una hipótesis.

Hoy, eso cambia gracias al trabajo del investigador de la Universidad de Washington en Seattle (EEUU) Po-shen Lee y sus compañeros, que han empleado un algoritmo de aprendizaje de máquinas para buscar las gráficas de los trabajos científicos para analizarlas y clasificarlas. Este trabajo revela por primera vez que las gráficas juegan un papel importante en el proceso científico. Lee afirma: "Encontramos una correlación signifivativa entre el impacto científico y el uso de informaciones visuales, en la que los trabajos de mayor impacto tienden a incluir un número mayor de diagramas, y en menor grado más diagramas y fotografías".

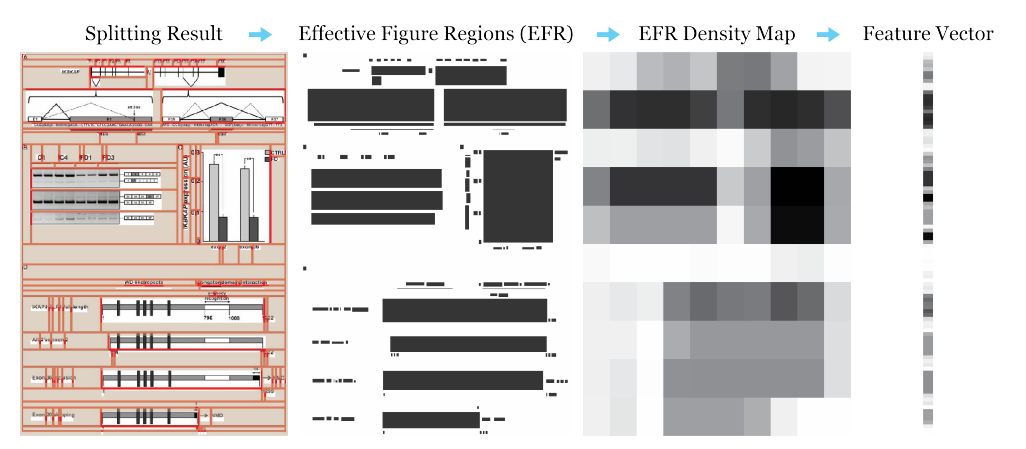

Empezaron por descargar 4,8 millones de imágenes de 650.000 trabajos científicos de la base de datos en línea PubMed Central, que aloja sobre todo trabajos de biología y biomedicina. El equipo de Lee entonces entrenó un algoritmo de visión de máquinas para descomponer imágenes de tablas múltiples en sus partes componentes. Esto agrandó la base de datos, proporcionando un total de 10 millones de imágenes para analizar, el 67% de ellas procedentes de imágenes de tabla múltiple.

El equipo entonces enseñó al algoritmo a reconocer cinco tipos distintos de imagen: diagramas, fotos, tablas, ventanas de datos y ecuaciones. Resulta que el tipo más común son las ventanas de datos, que representan un 35% del total, seguido por las fotos (22%), los diagramas (20%) y las ecuaciones (17%). Las tablas sólo representan el 5% de la base de datos.

Después, los investigadores analizaron cómo esta distribución varió por revista, disciplina y con el paso de tiempo. El responsable detalla; "Encontramos que la distribución de imágenes y tipos de imagen dentro de la literatura se ha mantenido constante con el paso del tiempo, pero puede variar ampliamente por campo y tema".

Pero su hallazgo más reseñable es que los trabajos más existosos tienden a incluir un número mayor de imágenes. Al representar gráficamente el número de diagramas por trabajo e impacto, el equipo concluyó que las ideas de alto impacto tienden a ser presentadas de forma visual.

El equipo de Lee sugiere dos posibles explicaciones: "O bien la información visual mejora la claridad del trabajo, lo que da paso a un mayor número de menciones y un impacto mayor, o los trabajos de alto impacto tienden naturalmente a incluir nuevas y complejas ideas que requieren una explicación visual".

Queda trabajo por hacer, por supuesto. El equipo de Lee es muy consciente del sesgo de PubMed hacia las ciencias biológicas y la biomedicina. Así que un próximo paso obvio consiste en incluir diagramas procedentes de las ciencias físicas. El blog Physics arXiv representa un recurso obvio por explotar.

El equipo también quiere explorar las propiedades de las diferentes representaciones de datos. Su objetivo es estudiar el nivel de éxito de distintos tipos de diagrama a la hora de presentar los datos, para generar pruebas que puedan convertir el arte negro del diseño de diagramas en una ciencia.

Es un trabajo interesante que proporciona la base para un tipo de ciencia totalmente nueva. El equipo lo denomina "viziometrics" (visiometría), la ciencia de la información visual. Esto imita la bibliometría, el estudio estadístico de las publicaciones, y la cienciometría, el estudio de la medición científica.

El trabajo deja tras sí una importante legado. La base de datos del equipo de Lee permite búsquedas y está disponible en www.viziometrics.org. Resulta interesante navegarla. Introduzca un término científico y el motor de búsquedas devolverá un amplio abanico de diagramas, fotos y otras imágenes relacionadas con el tema.

Esto permite a los científicos buscar entre la literatura científica a otro nivel de abstracción. En otras palabras, les permite razonar sobre la ciencia y los datos de manera distinta. Seguramente represente una potente herramienta nueva que podría tener un impacto profundo sobre la manera en la que generamos, buscamos y accedemos a las informaciones científicas. Seguramente Anscombe se habría quedado maravillado.

Ref: arxiv.org/abs/1605.04951: Viziometrics: Analyzing Visual Information in the Scientific Literature