Si las redes neuronales están inspiradas en nuestro cerebro, cabe esperar que se comporten de la misma forma. Y eso es precisamente lo que ha sucedido en este experimento basado en las leyes de Gestalt sobre la percepción de un todo a partir de sus partes

En la primera mitad del siglo XX, un grupo de psicólogos experimentales alemanes comenzó a preguntarse cómo era posible que el cerebro adquiriera percepciones significativas a partir de un mundo tan caótico e impredecible. Para responder a esta cuestión, desarrollaron las leyes de la Gestalt, basadas en la idea de que, cuando se trata de la percepción, el todo es diferente a la suma de sus partes.

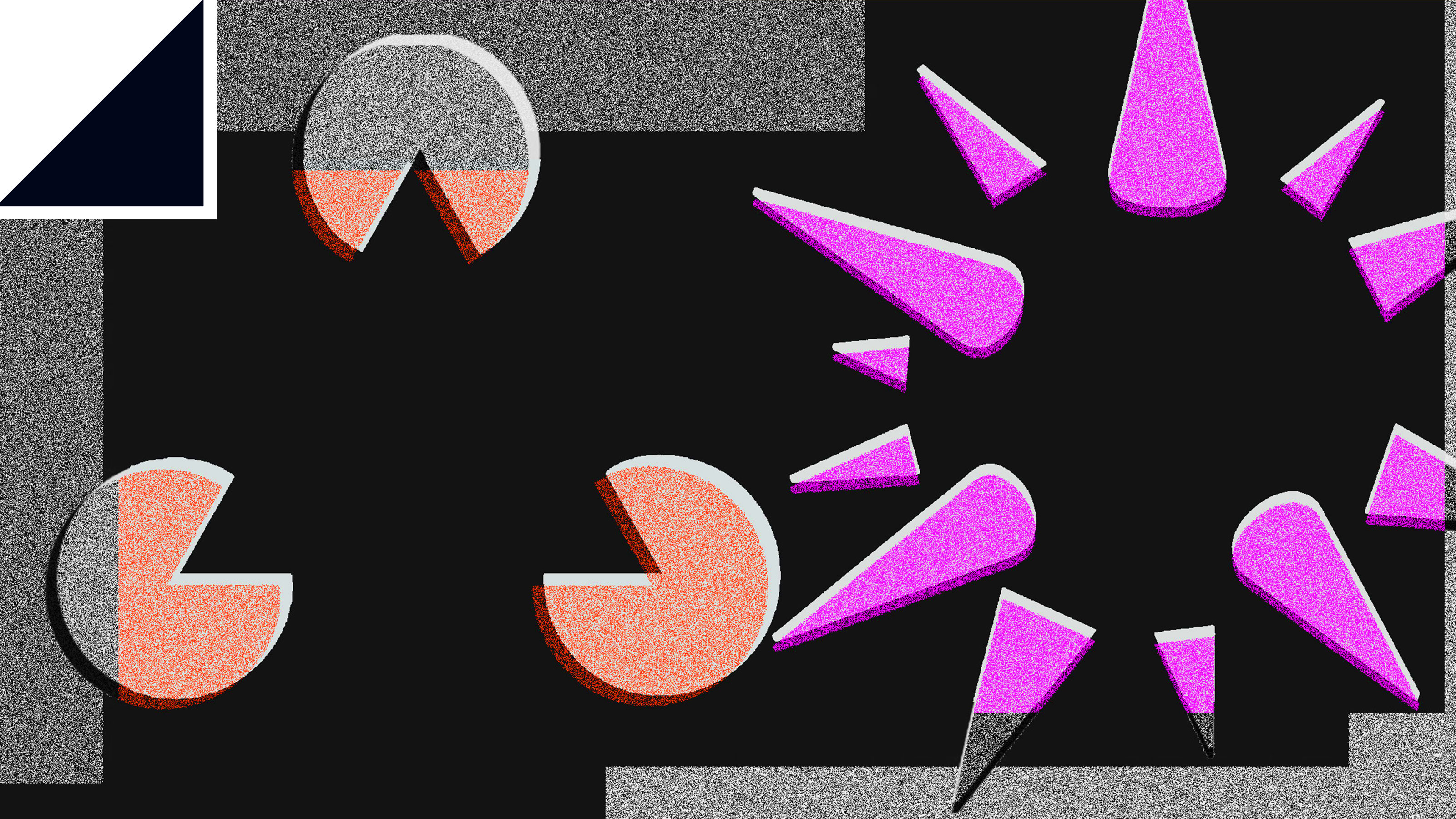

Desde entonces, los psicólogos han descubierto que al cerebro humano se le da muy bien percibir imágenes completas a partir de información fragmentada. Un buen ejemplo es la figura inferior. El cerebro percibe formas bidimensionales, como un triángulo y un cuadrado, e incluso una esfera tridimensional. Pero ninguna de estas formas está dibujada explícitamente. En su lugar, el cerebro llena los huecos.

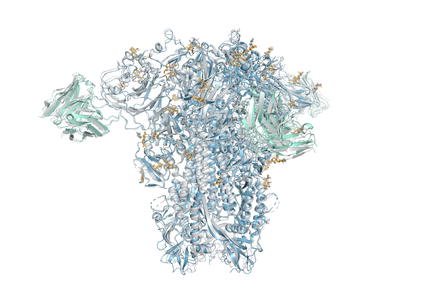

Una extensión natural de este trabajo consiste en analizar si las redes neuronales reproducen el efecto gestáltico. Estas redes están inspiradas en el cerebro humano. De hecho, los expertos en visión artificial afirman que las redes neuronales profundas resultan muy similares al sistema visual de los primates y a algunas zonas de la corteza cerebral humana.

Esto plantea una pregunta interesante: ¿pueden las redes neuronales percibir un objeto completo mediante la observación de sus partes, como hacemos los humanos? Esto es lo que ha intentado averiguar el investigador de Google Brain, la división de investigación de inteligencia artificial IA de la compañía, Been Kim y sus colegas. Los investigadores han sometido a varias redes neuronales a los mismos experimentos de la Gestalt diseñados para humanos. Y afirman que las máquinas sí son capaces de percibir objetos enteros a partir de sus partes.

El experimento se basa en la ilusión del triángulo de la imagen. Primero crearon tres bases de datos de imágenes para entrenar sus redes neuronales. La primera consistía en triángulos completos ordinarios mostrados en su totalidad. La segunda base de datos solo mostraba las esquinas de los triángulos, con líneas que debían interpolarse para percibir la forma completa. Era el conjunto de datos ilusorios. Cuando los humanos ven este tipo de imágenes, tienden a completar las líneas y terminan percibiendo el triángulo como un todo. La investigación detalla: "Nuestro objetivo era determinar si las redes neuronales manifestaban un efecto de cierre similar".

La última base de datos consistía en "esquinas" similares pero orientadas al azar para que las líneas no pudieran interpolarse para formar triángulos. Este era el conjunto de datos no ilusorios. Al cambiar el tamaño y la orientación de estas formas, el equipo pudo crear casi 1.000 imágenes diferentes para entrenar a sus máquinas.

Su enfoque consistió en entrenar una red neuronal para reconocer triángulos completos ordinarios y luego ver si era capaz de clasificar las imágenes del conjunto de datos ilusorios como triángulos completos al tiempo que ignoraba las imágenes del conjunto de datos no ilusorios. En otras palabras, querían comprobar si la máquina podía completar los huecos en las imágenes para formar una imagen completa.

También compararon el comportamiento de una red entrenada con el comportamiento de una red no entrenada o una entrenada con datos aleatorios. Los resultados son interesantes.

Resulta que el comportamiento de las redes neuronales entrenadas muestra notables similitudes con el efecto gestáltico humano. La investigación afirma: "Nuestros hallazgos sugieren que las redes neuronales entrenadas con imágenes naturales demuestran que saben hacer el cierre, a diferencia de las redes entrenadas con imágenes aleatorias o redes que han sido entrenadas con los datos visualmente aleatorios".

Se trata de un resultado fascinante. Y no solo porque demuestra que las redes neuronales imitan al cerebro para dar sentido al mundo. Lo más importante es que el planteamiento del equipo abre la puerta a una forma completamente nueva de analizar las redes neuronales con herramientas de la psicología experimental. El artículo concluye: "Creemos que explorar otras leyes de la Gestalt, y en general, otros fenómenos psicofísicos, en el contexto de las redes neuronales es un área prometedora para las futuras investigaciones".

Su trabajo parece un primer paso hacia un nuevo campo de la psicología de las máquinas, o psicología artificial. Como lo expresó el equipo de Google: "Comprender en qué se diferencian los humanos y las redes neuronales será útil para investigar la interpretabilidad al mostrar las diferencias fundamentales entre las dos especies". A los psicólogos experimentales alemanes de principios del siglo XX seguramente les hubiera fascinado todo esto.

Ref: arxiv.org/abs/1903.01069: Do Neural Networks Show Gestalt Phenomena? An Exploration of the Law of Closure