Un sistema de visión artificial combina entrenamiento con luz visible y ondas de radio para identificar las acciones de personas ocultas tras cualquier estructura. Dado que el sistema no puede reconocer caras, no presenta problemas de privacidad y podría usarse para monitorizar a personas mayores

La visión artificial tiene un historial impresionante. Tiene una capacidad sobrehumana para reconocer personas, rostros y objetos. Incluso puede identificar diferentes tipos de acciones, aunque eso todavía no lo hace tan bien como nosotros. Pero su rendimiento tiene límites. Las máquinas tienen especiales dificultades cuando las personas, caras u objetos están parcialmente ocultos. Y cuando hay muy poca luz, acaban deslumbradas, al igual que los humanos.

Pero hay otra parte del espectro electromagnético que no tiene estas limitaciones. Las ondas de radio llenan nuestro mundo, ya sea de noche o de día. Atraviesan fácilmente las paredes y se transmiten y reflejan mediante los cuerpos humanos. De hecho, los investigadores han desarrollado varias formas de usar señales de radio wifi para ver tras una puerta cerrada. Sin embargo, estos sistemas de visión por radio también tienen algunas deficiencias. Su resolución es baja; las imágenes tienen ruido y están llenas de reflejos que distraen, lo que hace que sea difícil entender lo que ocurre.

En este sentido, las imágenes de radio y las imágenes de luz visible presentan ventajas y desventajas complementarias. Y eso plantea la posibilidad de utilizar los puntos fuertes de cada una para superar las deficiencias de la otra.

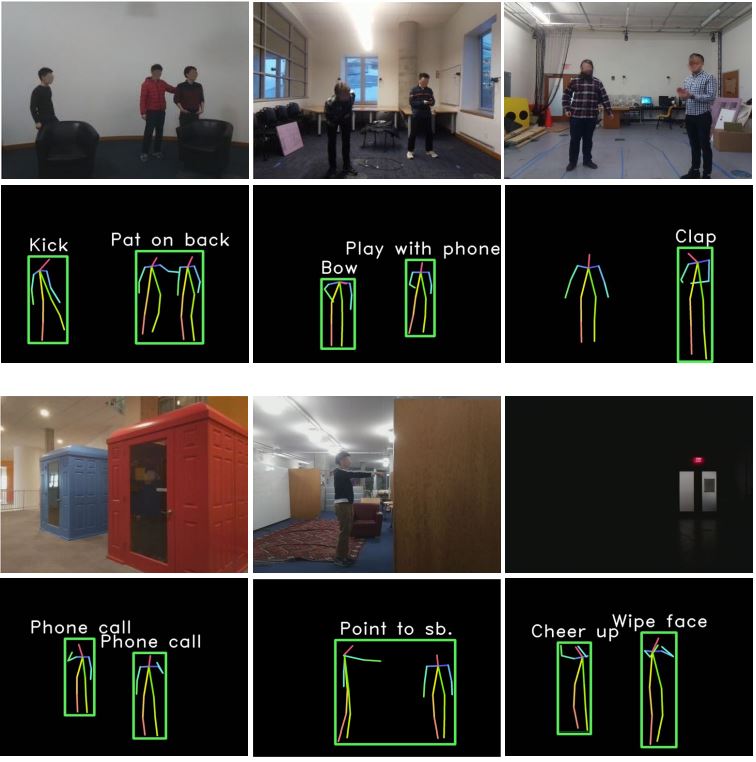

La investigadora del MIT (EE. UU.) Tianhong Li y sus colegas han encontrado una manera de enseñar a un sistema de visión por radio a reconocer las actividades de las personas al entrenarlo con imágenes de luz visible. El nuevo sistema de visión por radio puede ver qué hacen los individuos en una amplia gama de situaciones en las que la imagen de luz visible falla. Li detalla: "Presentamos un modelo de red neuronal capaz de detectar las acciones humanas a través de las paredes y oclusiones, y en condiciones de poca luz".

El método se basa en un truco muy bueno. Consiste en grabar imágenes de vídeo de la misma escena con luz visible y ondas de radio. Los sistemas de visión artificial pueden reconocer las acciones humanas a partir de las imágenes de luz visible. Entonces, el siguiente paso es correlacionar esas imágenes con las de radio de la misma escena.

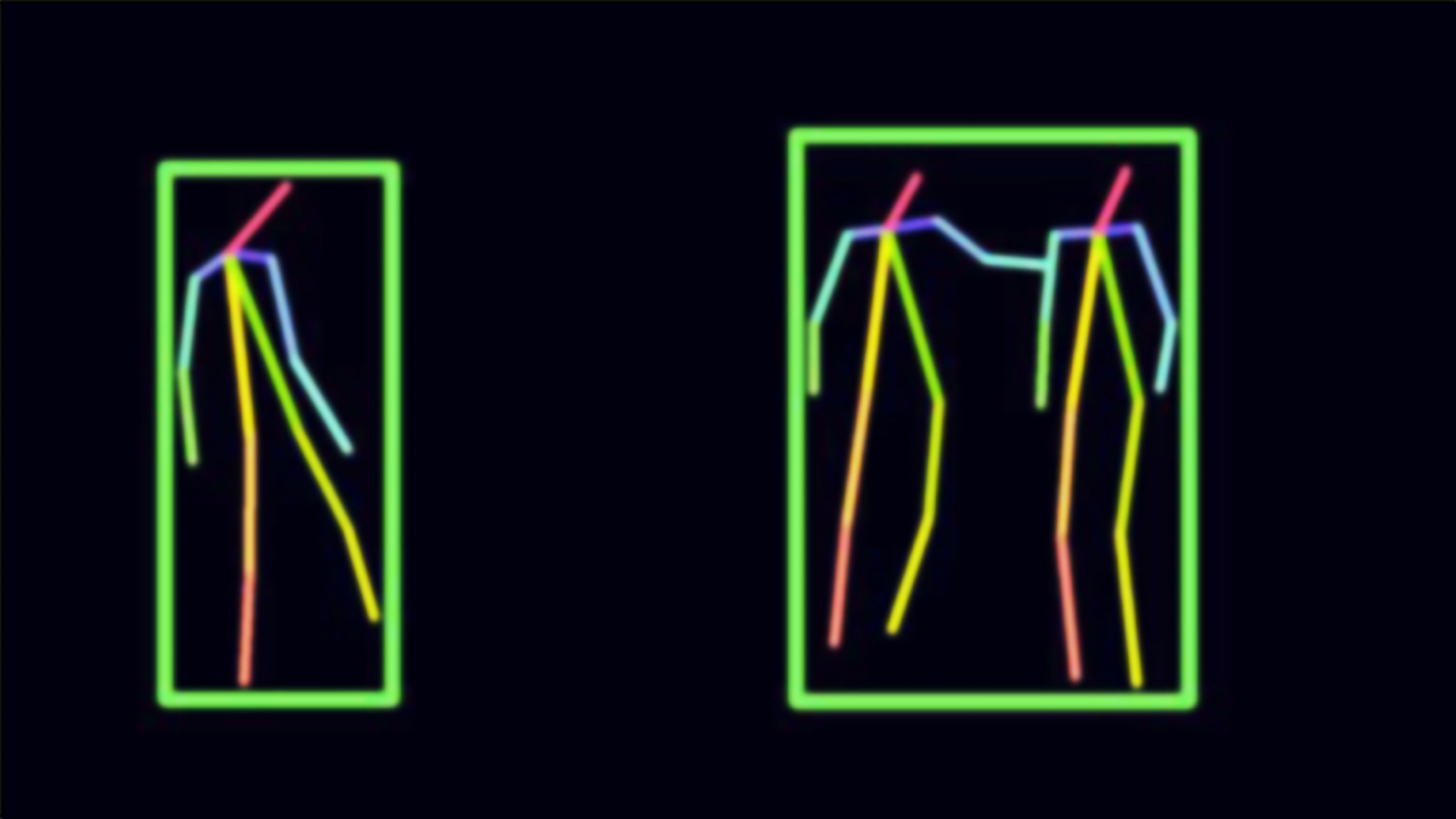

Pero la dificultad radica en garantizar que el proceso de aprendizaje se centre en el movimiento humano y no en otros elementos, como en el fondo, por ejemplo. Por eso, Li y sus compañeros introducen un paso intermedio en el que la máquina genera unos modelos en 3D de figuras de palo que reproducen las acciones de las personas en la escena. Li continúa: "Al traducir los datos a una representación intermedia tipo esqueleto, nuestro modelo puede aprender de los conjuntos de datos basados en la visión y en la radiofrecuencia, y permite que las dos tareas se ayuden mutuamente".

De esta manera, el sistema aprende a reconocer las acciones con luz visible y luego a identificar las mismas acciones en la oscuridad o detrás de las paredes mediante ondas de radio. La investigadora detalla: "Demostramos que nuestro modelo logra una precisión comparable a los sistemas de reconocimiento de acciones basados en la visión en escenarios visibles, pero lo hace con precisión cuando las personas no son visibles".

Se trata de un trabajo interesante con un importante potencial. Las aplicaciones obvias se encuentran en los escenarios donde las imágenes de luz visible fallan, en condiciones de poca luz y a puerta cerrada. Pero también hay otras aplicaciones.

Un problema con las imágenes de luz visible es que las personas son reconocibles, lo que plantea problemas de privacidad. Pero un sistema de radio no tiene la resolución para el reconocimiento facial. Identificar acciones sin reconocer rostros no genera los mismos problemas de privacidad. Li concluye: "Puede ofrecer reconocimiento de acciones en los hogares y permitir su integración en los sistemas domésticos inteligentes". Se podría usar para monitorizar la casa de una persona mayor y alertar a los servicios correspondientes sobre una caída, por ejemplo. Y lo haría sin mucho riesgo para la privacidad.

Eso está más allá de la capacidad de los actuales sistemas basados en la visión.

Ref: arxiv.org/abs/1909.09300: Making the Invisible Visible: Action Recognition Through Walls and Occlusions