Estas imágenes extraídas de una red neuronal artificial explican por qué el aprendizaje profundo está dando lugar a softwares que ven mejor que los humanos

El software se ha vuelto mucho, mucho más capaz de entender las imágenes. El año pasado, Microsoft y Google presentaron sistemas más precisos que los humanos a la hora de reconocer objetos dentro de las fotos, según la medida estándar que emplean los investigadores.

Esto ha sido posible gracias a una técnica llamada aprendizaje profundo, que alimenta grandes redes de neuronas artificiales con datos para entrenarlas para filtrar datos futuros (ver El hombre que enseña a las máquinas a entender el lenguaje). El aprendizaje profundo es el motivo por el que se puede buscar entre las fotos almacenadas en Google Imágenes por palabras clave, y por qué Facebook reconoce a sus amigos en las fotos antes de que los etiquete. Emplear el aprendizaje profundo con las imágenes también está volviendo más prácticos los robots y los coches autónomos, y podría revolucionar la medicina.

Esa potencia y flexibilidad nace del propio funcionamiento de la red artificial de neuronas, según el cual es capaz de averiguar qué características físicas buscar dentro de las imágenes gracias a otro montón de fotos etiquetadas de ejemplo. Las redes neuronales empleadas en el aprendizaje profundo están dispuestas en una jerarquía de capas por las que pasan los datos en secuencia. Durante el proceso de entrenamiento, distintas capas dentro de la red se especializan para identificar diferentes tipos de características visuales. El tipo de red neuronal empleado para las imágenes, conocido como red neuronal convolucional, se inspiró en los estudios de la corteza visual de los animales.

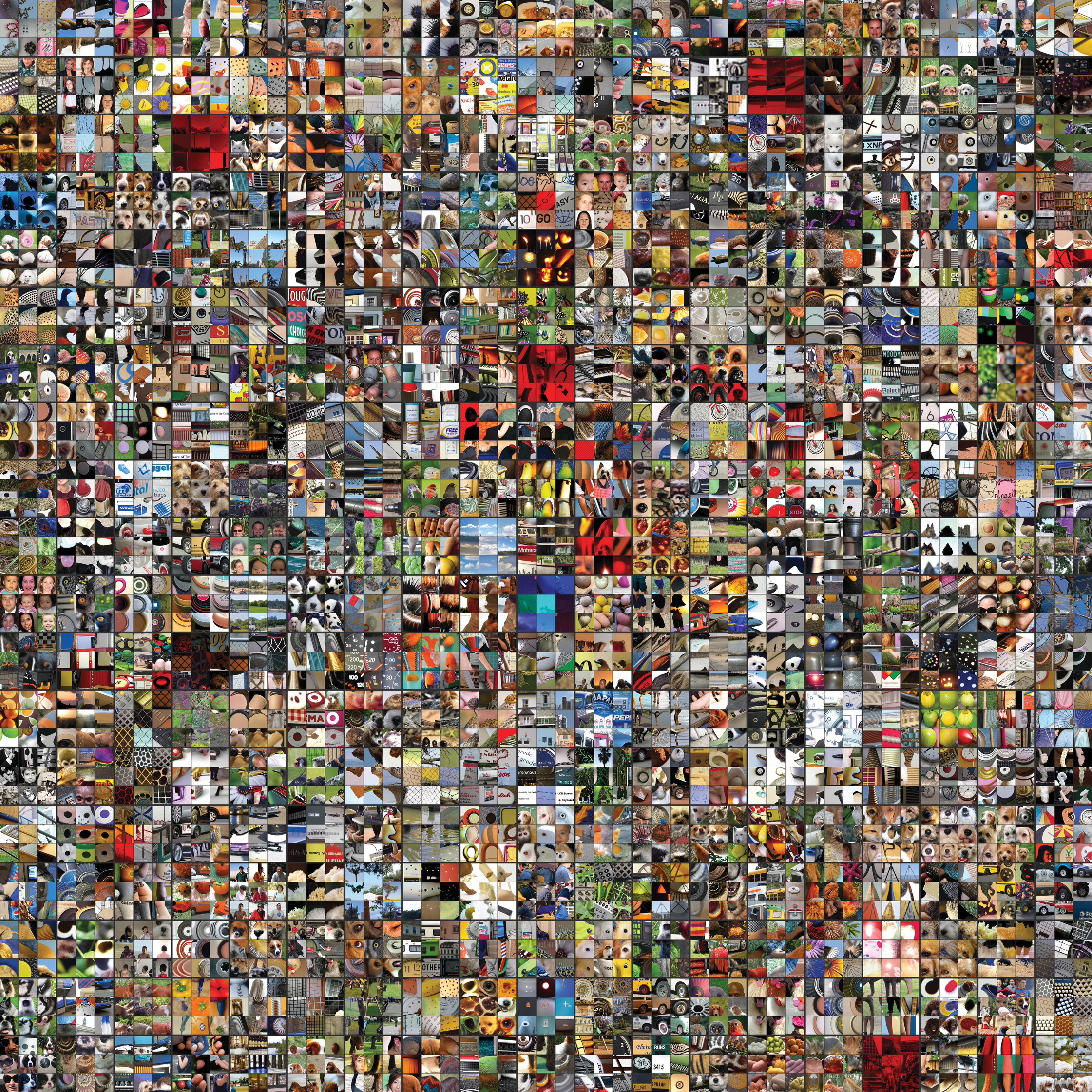

Foto: Las primeras capas de la red neuronal sólo visualizan pequeñas secciones de una imagen a la vez y se especializan para detectar sencillos patrones. Aquí se puede observar cómo unas simples categorías de color y tonalidad podrían ayudar a divisar colores y bordes.

Foto: La siguiente capa de la red emplea los filtros de la primera capa como bloques de construcción para examinar trozos más grandes de una imagen y detectar unas características más complejas. Responde a patrones como esquinas, rayas y rejillas.

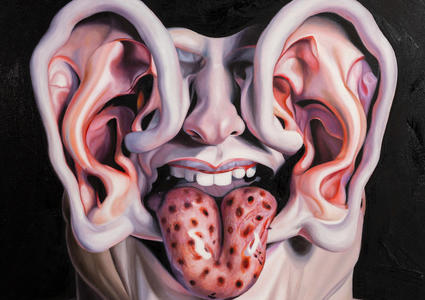

Foto: La tercera capa de la red demuestra cómo el desarrollo continuo de las características detectadas por capas anteriores posibilita distinguir partes de los objetos. Una forma redonda y naranja como un tomate puede ser diferenciado de otra forma blanca y peluda, como un conejo.

Foto: Las capas más sofisticadas de procesamiento de imágenes dentro de la red neuronal responden a conjuntos muy complejos de características que corresponden a conceptos de mayor elaboración, como flores y personas. Esa es la quinta de ocho capas dentro de la red. Su producto final es traducido por las siguientes tres capas para asignar puntuaciones numéricas que indican cómo la red ha identificado la imagen que acaba de estudiar.

"Estas redes representan un enorme salto respecto a los métodos tradicionales de visión de máquinas, puesto que aprenden directamente de los datos con los que son alimentadas", explica el CEO de Clarifai, Matthew Zeiler. Su compañía ofrece un servicio de reconocimiento de imágenes que utilizan empresas como BuzzFeed para organizar y buscar entre fotos y vídeos. Antes, los programadores tenían que inventarse el software matemático necesario para buscar características visuales. Y los resultados no eran lo suficientemente buenos como para desarrollar productos útiles.

Zeiler desarrolló una manera de visualizar el funcionamiento de las redes neuronales mientras cursaba su postgrado en colaboración con Rob Fergus en la Universidad de Nueva York (EEUU). Las imágenes de este artículo nos adentran en una red de aprendizaje profundo entrenada con 1,3 millones de fotos para la prueba estándar de reconocimiento de imágenes en la que estos sistemas ya superan a los humanos. El software es capaz de distinguir 1.000 objetos tan diversos como una mosquitera y unos mosquitos. Cada imagen muestra características visuales que activan de forma más pronunciada las neuronas de una determinada capa de la red.