Un nuevo conjunto de más de 13.500 ataques personales podría ayudar a entrenar algoritmos para acabar con los ataques y la hegemonía del hombre blanco en sus foros de debate

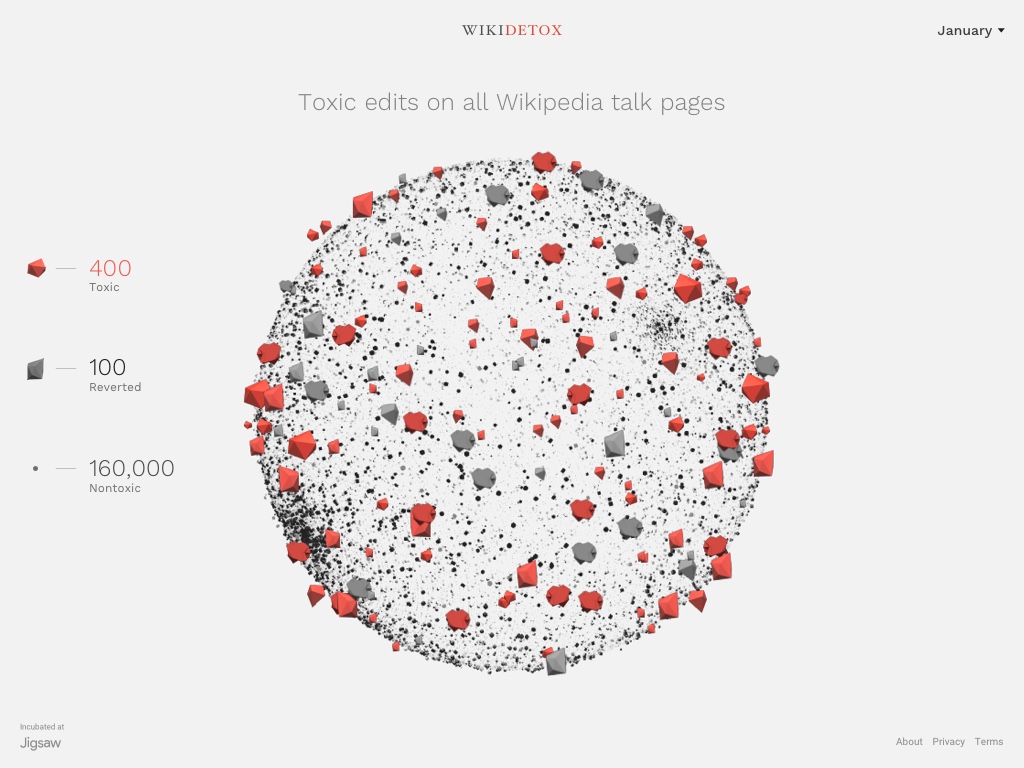

Foto: Una visualización de actualizaciones en páginas de debate de Wikipedia en enero muestra la incidencia de ataques personales, señalados en rojo. Crédito: Jigsaw (Wikimedia Commons).

Foto: Una visualización de actualizaciones en páginas de debate de Wikipedia en enero muestra la incidencia de ataques personales, señalados en rojo. Crédito: Jigsaw (Wikimedia Commons).

Misoginia, racismo, obscenidades.... eso es lo que incluye un conjunto de más de 13.500 ataques personales en internet.

Esta base de datos de mensajes desagradables proviene de las páginas de debate de Wikipedia. La colección, junto a otras más de 100.000 actualizaciones neutras, ha sido publicada por los investigadores de Alphabet y la Fundación Wikimedia, la organización sin ánimo de lucro responsable de Wikipedia. Las entidades afirman que los datos ayudarán a mejorar los trabajos para entrenar a un software para que comprenda y supervise el acoso en línea.

El director de investigaciones científicas de Jigsaw, un grupo dentro de Alphabet que desarrolla tecnologías al servicio de causas como la libertad de expresión y la lucha contra la corrupción, Lucas Dixon, explica: "Nuestro objetivo consiste en averiguar cómo podemos ayudar a la gente a debatir de manera productiva sobre los temas más controvertidos e importantes"

Investigadores de Jigsaw y Wikimedia utilizaron un servicio de crowdsourcing para estudiar más de 115.000 mensajes publicados en las páginas de debate de Wikimedia. Querían detectar cualquier comentario que representara un ataque personal según la definición de las reglas de la comunidad. Los colaboradores ya han utilizado los datos para entrenar algoritmos de aprendizaje automático que igualan el rendimiento de los trabajadores de crowdsourcing en la identificación de ataques personales. Cuando los alimentaron con la colección completa de 63 actualizaciones de debate hechas por editores de Wikipedia, descubrieron que los moderadores solo actuaron en el 10% de los ataques.

Reducir los acosos entre editores de Wikipedia se convirtió en una prioridad de la Fundación Wikimedia el año pasado. Esta política se suma a esfuerzos existentes de suavizar el ambiente espinoso y burocrático de la comunidad Wikipedia, el cual limita la participación de nuevos editores. Ambos problemas podrían ayudar a explicar por qué cada vez hay menos y por qué la plataforma no ha conseguido más participación que no proceda de su segmento poblacional principal: los hombres occidentales (ver La agonía de Wikipedia).

Jigsaw y la Fundación Wikimedia no son los primeros en estudiar el acoso en internet, ni son los primeros que intentan diseñar software capaz de detectarlo y combatirlo. Lo que no era tan común era disponer de una colección semejante de comentarios etiquetados para identificar las actualizaciones abusivas y las que no. Para ello, es necesario entrenar algoritmos de aprendizaje automático, según el investigador de ciencias de datos de la Fundación Wikimedia Ellery Wulczyn.

El responsable calcula que este conjunto de ataques personales y comentarios de Wikipedia es entre 10 y 100 veces más grande que los anteriores. Y ya se sabe que los algoritmos de aprendizaje automático necesitan grandes cantidades de ejemplos etiquetados para aprender a filtrar datos con precisión.

Aún no está claro si los algoritmos entrenados para detectar abusos podrán hacer de moderadores eficaces. Al software aún le falta mucho para entender todos los matices del lenguaje. Algunas personas podrían intentar afinar su lenguaje abusivo para evadir la detección, según Wulczyn de Wikimedia. "Si quisiéramos desarrollar un tipo de intervención con la que los humanos fuéramos a mantener un enfrentamiento, no sabemos qué pasaría", concluye.