PlaNet ha derrotado a 10 humanos en el reto de adivinar dónde ha sido tomada una imagen de Street View elegida al azar. Y la memoria necesaria para ejecutar el programa cabe dentro de un 'smartphone'

Aquí va una tarea complicada. Escoja una foto de internet al azar. Ahora, intente averiguar dónde fue sacada a partir del contenido de la propia imagen. Si muestra un edificio o monumento famoso, como la Torre Eiffel o las Cataratas del Niágara, la tarea le resultará sencilla. Pero la cosa se complica bastante si la imagen carece de pistas específicas de localización, ha sido tomada en interiores o muestra una mascota o algún otro detalle concreto.

Sin embargo, a pesar de lo complicado que resulta, a los humanos se nos da sorprendentemente bien. Eso se debe a que empleamos toda clase de conocimiento que tenemos del mundo, como el tipo y lenguaje de las señales mostradas, la vegetación, los estilos arquitectónicos y la dirección del tráfico, entre otros. Nos pasamos toda la vida acumulando este tipo de datos en el cerebro.

Lo lógico sería pensar que trasladar esta tarea a una máquina resultaría bastante complicado. Y así ha sido hasta ahora, ya que gracias al trabajo del especialista en visión de máquinas de Google Tobias Weyand podría cambiar. Junto a su equipo, ha entrenado una máquina de aprendizaje profundo para averiguar la ubicación de casi cualquier foto a partir de los píxeles que contiene.

Su nueva máquina rinde mejor que los humanos. Emplea un ingenioso truco para determinar la ubicación de imágenes de interiores y fotos de cosas específicas como mascotas y comida que carecen de información sobre su localización.

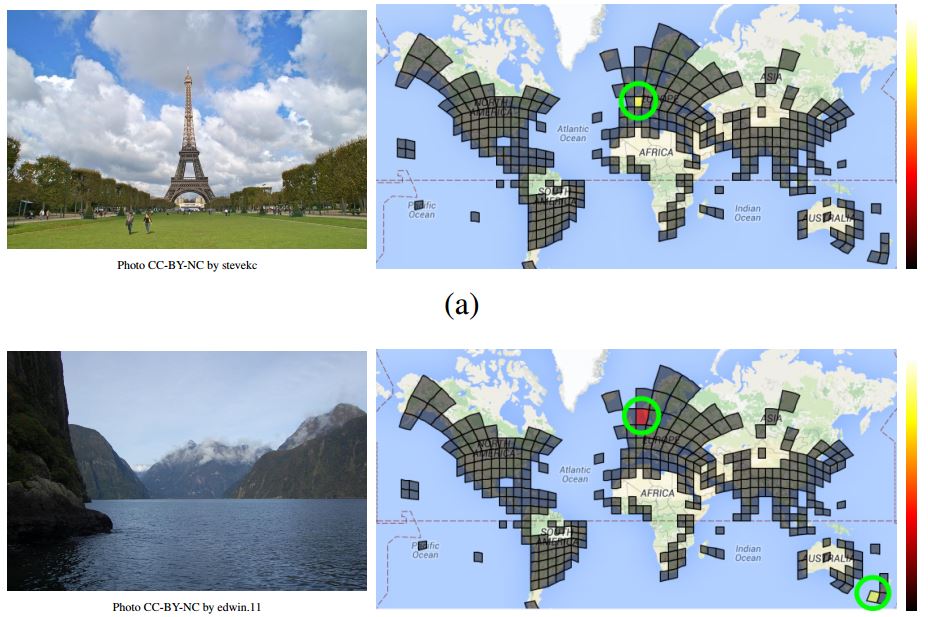

El enfoque es sencillo, al menos dentro del mundo del aprendizaje de máquinas. El equipo de Weyland empezó por dividir el mundo en una red de más de 26.000 cuadrículas de distintos tamaños que dependen del número de imágenes sacadas desde esa ubicación.

Las grandes ciudades, que aparecen en muchas imágenes, tienen una estructura de cuadrículas más detallada que las regiones más remotas donde los fotógrafos son menos comunes. De hecho, el equipo de Google ignoró zonas como océanos y las regiones polares, donde se han sacado pocas fotos.

Después, el equipo creó una base de datos de imágenes geolocalizadas de internet y utilizó sus datos de ubicación para determinar la cuadrícula en la que se sacó cada foto. Este conjunto de datos contiene 126 millones de imágenes junto con sus correspondientes datos de localización.

El equipo de Weyland utilizó 91 millones de estas imágenes para enseñar a una potente red neuronal a averiguar la ubicación dentro de la cuadrícula con el uso exclusivo de la propia imagen. Su concepto consiste en introducir una imagen a esta red neuronal y recibir en respuesta una determinada ubicación dentro de la cuadrícula o un conjunto de candidatos probables. Entonces validaron la red neuronal con los 35 millones de imágenes restantes del conjunto de datos. Finalmente, probaron la red, llamada PlaNet, de varias formas para comprobar su rendimiento.

Los resultados ofrecen una lectura interesante. Para medir la precisión de su máquina, la alimentaron con 2,3 millones de imágenes geoetiquetadas de Flickr para comprobar si podía determinar correctamente su ubicación. "PlaNet es capaz de localizar el 3,6% de las imágenes con una precisión a nivel de calle, y el 10,1% con una precisión a nivel de ciudad", afirma el equipo de Weyland. Además, la máquina determina el país de origen en un 28,4% de las imágenes y el continente en un 48% de ellas.

Está bastante bien. Pero, para demostrar cuánto, el equipo de Weyland hizo competir a PlaNet contra 10 humanos muy viajeros. Para la prueba, emplearon un videojuego que presenta una vista sacada de Google Street View al jugador y le pide que determine su ubicación dentro de un mapamundi. Cualquiera puede jugar en www.geoguessr.com. Inténtelo , es muy divertido y más complicado de lo que parece.

Huelga decir que PlaNet barrió a los humanos. "En total, PlaNet ganó 28 de las 50 rondas con una tasa media de error de localización de 1.131,7 kilómetros, mientras que la tasa de error humana fue de 2.320,75 kilómetros", afirma el equipo de Weyland. "[Este] experimento a pequeña escala demuestra que PlaNet alcanza un nivel de rendimiento superhumano a la hora de geolocalizar las escenas de Street View".

La pregunta ahora es cómo logra PlaNet un rendimiento tan alto sin depender de las pistas que usamos los humanos, como la vegetación y el estilo arquitectónico. Weyland y su equipo afirman saber por qué: "Creemos que PlaNet tiene una ventaja frente a los humanos porque ha visto muchos más lugares de los que puede visitar un humano y ha aprendido unas pistas sutiles de diferentes entornos que resultan difíciles de distinguir incluso a un humano muy viajado".

Pero el equipo no se ha quedado ahí. El siguiente reto para la máquina ha sido ubicar imágenes que no muestran ni un solo dato sobre su localización, como las de interiores y objetos concretos. Esto es posible cuando las imágenes forman parte de álbumes del mismo lugar. La máquina simplemente repasa otras imágenes del mismo álbum para averiguar dónde fueron sacadas y asume que la imagen más específica habrá sido tomada en la misma ubicación.

Es un trabajo impresionante que muestra profundas redes neuronales sacando molla de nuevo. Tal vez resulte más impresionante aún que el modelo emplea una cantidad relativamente pequeña de memoria a diferencia de otros enfoques que requieren muchos gigabytes. Weyland detalla: "Nuestro modelo sólo emplea 377 MB, lo que cabe incluso dentro de la memoria de un smartphone".

Es una idea seductora, el poder de una red neuronal superhumana en un smartphone. ¡Seguramente ya no falte mucho!

Ref: arxiv.org/abs/1602.05314 : PlaNet—Photo Geolocation with Convolutional Neural Networks