Cadenas de bloques y aplicaciones

Un ataque ultrasónico podría hacerse con el control de tu asistente por voz

Un grupo de investigadores chinos desarrolla una forma de activar y manipular asistentes virtuales controlados por voz a partir de ultrasonidos y sin que el usuario lo pueda detectar

Los asistentes virtuales controlados por voz son cada vez más comunes y sofisticados. Google, Apple, Amazon, numerosos fabricantes de automóviles y otras compañías permiten controlar sus dispositivos mediante voz. Algo que, por supuesto, también ofrece a los atacantes malintencionados una tentadora forma de apuntar a esos aparatos.

Muchas de las personas con dispositivos controlables por voz habrán experimentado activaciones anómalas: el dispositivo reacciona a las voces de otros sujetos e interpreta el ruido externo como una orden. No es difícil imaginar entonces cómo podría aprovechar un hacker un altavoz cercano para lanzar su propio ataque. Sin embargo, estos ataques pueden ser frenados fácilmente por los propios usuarios si están alerta y escuchan las órdenes.

Pero esto plantea una pregunta interesante: ¿es posible activar un asistente controlado por voz con órdenes inaudibles?

Hoy tenemos una respuesta gracias al trabajo de los investigadores de la Universidad de Zhejiang (China) Guoming Zhang, Chen Yan y algunos de sus compañeros. El grupo de investigadores ha desarrollado un sistema llamado DolphinAttack que utiliza mensajes ultrasónicos para activar asistentes digitales, como Siri, Google Now y el sistema de navegación controlado por voz de Audi. Estos mensajes son totalmente inaudibles para el oído humano y, según el equipo, suponen una amenaza a tener en cuenta.

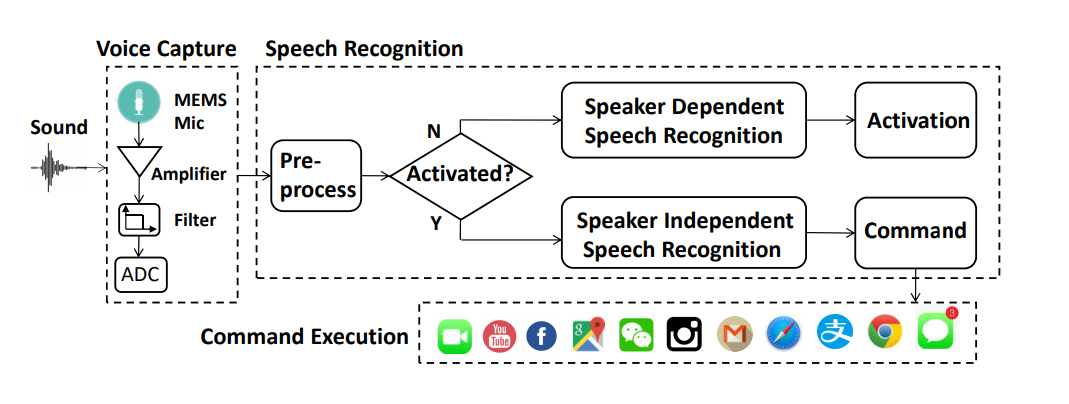

El principio que hay detrás del ataque es simple. Los micrófonos utilizados en los dispositivos electrónicos modernos están diseñados para convertir el sonido audible en señales electrónicas, es decir, el sonido con una frecuencia inferior a unos 20 KHz, el límite por lo general aceptado por el oído humano.

Los micrófonos tienen una membrana deformable que vibra cuando es golpeada por las ondas de sonido. Esta vibración cambia la capacidad eléctrica de un circuito interno y convierte así el sonido en su forma electrónica.

Por diseño, estas membranas no son especialmente sensibles a las frecuencias ultrasónicas. En cualquier caso, las señales de frecuencia más alta son filtradas por la electrónica del dispositivo.

Pero Guoming y compañía han encontrado una manera de engañar a estos dispositivos. El truco consiste en utilizar una frecuencia ultrasónica que es modulada en amplitud por la frecuencia del habla ordinaria. Por lo tanto, el ultrasonido actúa como una onda portadora para el mensaje hablado.

La clave está en que las membranas del micrófono pueden captar estas señales a pesar de ser inaudibles para los seres humanos.

Esto abre una nueva caja de Pandora de daños y peligros. Guoming y compañía probaron su enfoque, entre otros, en varios iPhone de Apple, un LG Nexus 5X, un Samsung Note S6 borde, un Amazon Echo y un sistema de navegación Audi Q3.

Algunos de estos asistentes trabajan con cualquier voz, como el Echo de Amazon. Otros, solo pueden ser activados por una voz en particular, a pesar de que luego puedan manejarse con cualquier voz. En este caso, el equipo chino dice que es fácil probar varias voces diferentes para encontrar una lo suficientemente similar a la original como para completar la activación.

(Una observación común es que las personas con voces similares pueden activarse mutuamente el teléfono controlado por voz).

El equipo utilizó un Samsung Galaxy S6 Edge conectado a un altavoz ultrasónico para probar el ataque tanto en el laboratorio como en el mundo real, ruido de fondo incluido.

Los resultados son desconcertantes. "Mostramos que los comandos de voz de DolphinAttack, aunque totalmente inaudibles y por lo tanto imperceptibles para los seres humanos, pueden ser reconocidos por el hardware de audio de los dispositivos y entendidos correctamente por los sistemas de reconocimiento de voz", explican Guoming y su grupo.

El equipo utilizó el sistema para persuadir a Siri de que iniciara una llamada FaceTime en un iPhone, para obligar a Google Now a cambiar un teléfono al modo avión e, incluso, para manipular el sistema de navegación de un automóvil Audi.

Utilizar comandos más avanzados también es claramente posible. "Creemos que esta lista dista mucho de estar completa", dicen los investigadores.

Todo esto inquietará a los consumidores que se preocupan por la seguridad de sus dispositivos. No es difícil imaginar cómo un usuario malintencionado podría aprovechar este punto débil para iniciar en secreto llamadas que escuchen conversaciones a escondidas, apagar un teléfono y que no reciba datos, y redireccionar el sistema de navegación de un vehículo controlado por voz.

A medida que los sistemas controlados por voz se vuelven más capaces, la amenaza se vuelve también más grande y preocupante. El último Google Assistant, por ejemplo, es mucho más competente (de forma notable) que sus versiones anteriores.

Guoming y sus compañeros dicen que la amenaza se puede mitigar. La forma más obvia es rediseñar los micrófonos para reducir su sensibilidad a las ondas portadoras ultrasónicas. Esto debería ser sencillo, pero no ayuda a los millones de personas que ya poseen un teléfono inteligente, un asistente o un coche que puede estar en peligro.

Para este grupo, lo más práctico es una solución basada en software. Los comandos ultrasónicos difieren de las señales de voz naturales en unas cuantos aspectos únicos que deberían ser fáciles de detectar. Desarrollar un sistema de este tipo no debe ser demasiado complicado, pero la entrega del mismo a millones de usuarios sí lo será.

Mientras tanto, es fácil construir un teléfono inteligente modificado que pueda llevar a cabo este tipo de ataque. Lo que implica que millones de dispositivos inteligentes en todo el mundo están en riesgo.

Ref: arxiv.org/abs/1708.09537: DolphinAttack: Inaudible Voice Commands.