Tras el escándalo de Google en el Proyecto Maven del Departamento de Defensa de EE. UU., el organismo ha creado unas pautas éticas que sus colaboradores privados deberán seguir. Aunque suponen un gran paso adelante, su falta de detalle podría reducir su impacto

En 2018, los empleados de Google no quedaron muy contentos cuando se enteraron de la participación de su empresa en el Proyecto Maven (la controvertida iniciativa militar de EE. UU. para desarrollar inteligencia artificial -IA- con el fin de analizar vídeos de vigilancia). Miles de personas protestaron. En una carta a los directivos de la empresa, los empleados dijeron: "Creemos que Google no debería estar en el negocio de la guerra". Alrededor de una docena de empleados dimitió. Google decidió no renovar el contrato en 2019.

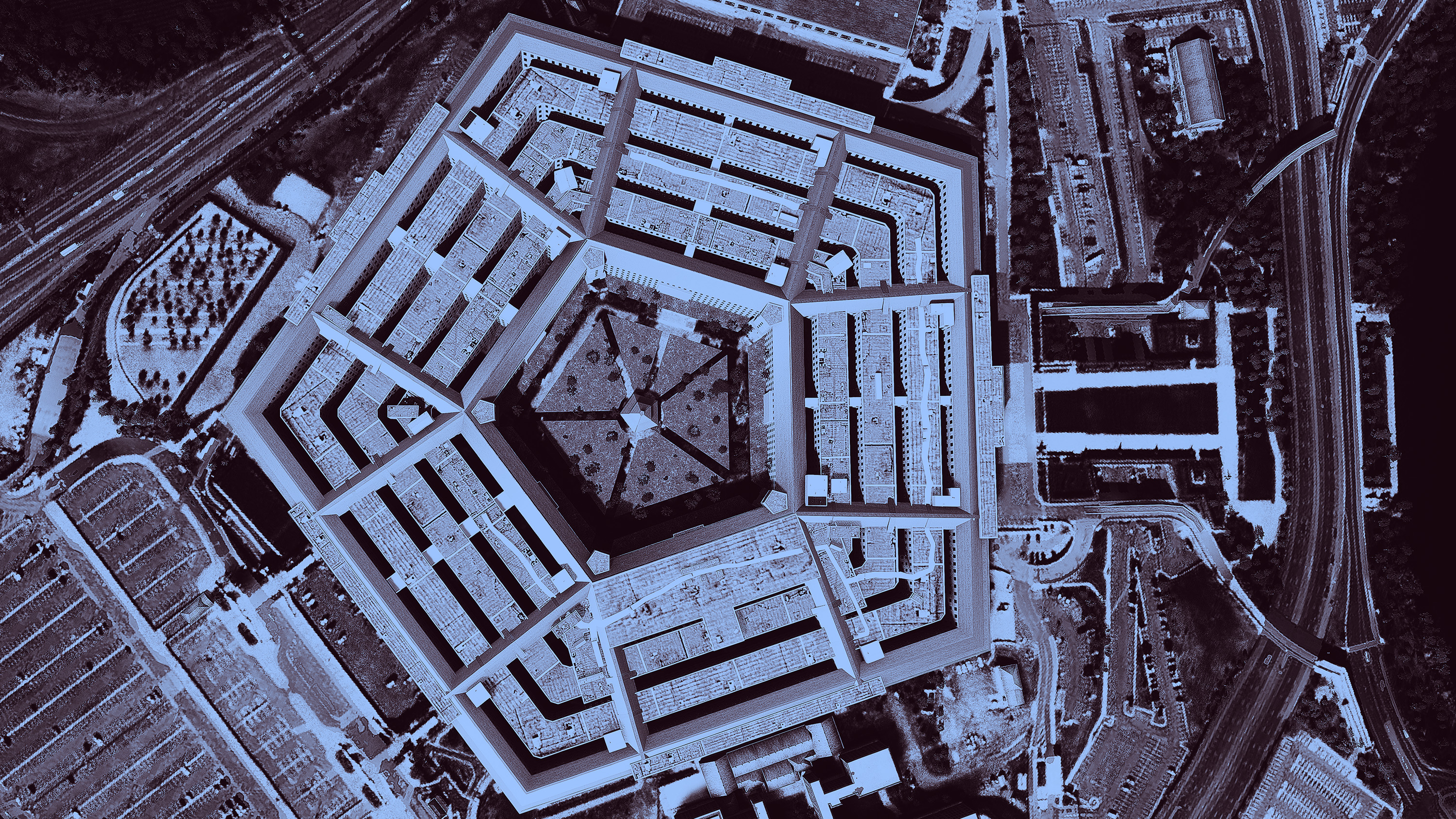

Pero el Proyecto Maven todavía existe, y otras empresas de tecnología, incluidas Amazon y Microsoft, han ocupado el lugar de Google. No obstante, el Departamento de Defensa de EE. UU. sabe que tiene un problema de confianza y que debe abordarlo para mantener su acceso las últimas tecnologías, especialmente a la IA, lo que requerirá asociarse con las Big Tech y otras organizaciones no militares.

En un intento por promover la transparencia, la Unidad de Innovación de Defensa, que otorga contratos del Departamento de Defensa a empresas privadas, ha publicado lo que denomina pautas para la "inteligencia artificial responsable". Los desarrolladores externos estarán obligados a cumplirlas cuando produzcan IA para el ejército, independientemente de si esa se destina a un sistema de recursos humanos o al reconocimiento de objetivos.

Las pautas ofrecen un proceso paso a paso que las empresas deben seguir durante la planificación, el desarrollo y la implementación. Incluyen procedimientos para determinar quién podría usar la tecnología, quién podría resultar perjudicado por ella, cuáles podrían ser esos daños y cómo podrían evitarse, tanto antes de que se construya el sistema como cuando esté en funcionamiento.

"No existen otras pautas que entren en este nivel de detalle, ni dentro del Departamento de Defensa ni, francamente, en el Gobierno de Estados Unidos", asegura su coautor de la Unidad de Innovación de la Defensa Bryce Goodman.

El trabajo podría cambiar la forma en la que el Gobierno de EE. UU. desarrolla la inteligencia artificial, si otros departamentos adoptan o adaptan las pautas del Departamento de Defensa. Goodman afirma que él y sus colegas las han enviado a la NOAA (Administración Nacional Oceánica y Atmosférica de EE. UU.) y al Departamento de Transporte y están hablando con grupos de ética dentro del Departamento de Justicia, la Administración de Servicios Generales y la IRS (Oficina de Impuestos sobre la Renta).

El propósito de las pautas, según Goodman, es asegurarse de que los proveedores de tecnología se adhieran a los principios éticos para la IA del Departamento de Defensa anunciados el año pasado, después de un estudio de dos años realizado por el Comité de Innovación de Defensa (el grupo asesor compuesto por investigadores líderes en tecnología y empresarios creado en 2016 para llevar una pizca de Silicon Valley a las fuerzas armadas de EE. UU.). Este comité estuvo presidido por el antiguo CEO de Google, Eric Schmidt, hasta septiembre de 2020, y sus miembros actuales incluyen a la directora del Laboratorio de Inteligencia Artificial y Ciencias de la Computación del MIT, Daniela Rus.

Sin embargo, algunos críticos cuestionan si este trabajo realmente logrará una transformación significativa.

Durante el estudio, el comité consultó a una serie de expertos, incluidos los mayores críticos del uso de la inteligencia artificial por parte de los militares, como los miembros de la Campaign for Killer Robots y la antigua investigadora de Google que ayudó a organizar las protestas contra el Proyecto Maven, Meredith Whittaker.

Whittaker, que actualmente dirige el cuerpo docente del AI Now Institute de la Universidad de Nueva York (EE. UU.), no estuvo disponible para hacer comentarios. Pero, según la portavoz del instituto, Courtney Holsworth, Whittaker asistió a una reunión, donde discutió con los miembros de alto rango del comité, incluido Schmidt, sobre la dirección a tomar. "Ella nunca fue consultada de manera significativa. Afirmar que sí lo fue podría entenderse como una forma de lavado de ética, en la que la presencia de voces disidentes durante una pequeña parte de un largo proceso se utiliza para afirmar que un resultado tiene una amplia aceptación por parte de los interlocutores relevantes", afirma Holsworth.

Si el Departamento de Defensa no tiene una amplia aceptación, ¿lograrán sus pautas ayudar a generar confianza? "Habrá personas que nunca estarán satisfechas con ningún conjunto de pautas éticas que elabore el Departamento de Defensa porque esa idea les parece paradójica. Es importante ser realista sobre lo que las pautas pueden hacer y lo que no", opina Goodman.

Por ejemplo, las nuevas pautas no dicen nada sobre el uso de armas autónomas letales, una tecnología que, según algunos activistas, se debería prohibir. Pero Goodman señala que las regulaciones que rigen dicha tecnología se deciden en una parte más alta de la cadena de mando. El objetivo de las pautas es facilitar la creación de sistemas de IA que cumplan con esas regulaciones. Y parte de ese proceso consiste en hacer explícita cualquier duda que tengan los desarrolladores externos. "Una aplicación válida de estas pautas es decidir no seguir con un sistema específico. Se puede decidir que algo no es una buena idea", explica otro coautor de las mismas de la Unidad de Innovación de la Defensa Jared Dunnmon.

La investigadora de IA en Hugging Face Margaret Mitchell, que codirigió el equipo de Ética para la IA de Google con Timnit Gebru antes de que ambas fueran despedidas de la empresa, está de acuerdo en que las pautas éticas pueden ayudar a que un proyecto sea más transparente para quienes trabajan en él, al menos en teoría. Mitchell estaba en las primeras filas durante las protestas en Google. Una de las principales críticas de los empleados fue que la empresa estaba entregando una tecnología muy potente a los militares sin ninguna protección. Y añade: "La gente se terminó porque no había ningún tipo de pauta clara ni transparencia".

Opina que los problemas no están claramente definidos: "Creo que algunas personas en Google definitivamente pensaban que cualquier colaboración con el ejército era mala. Yo no soy una de esas personas". Mitchell ha estado hablando con el Departamento de Defensa estadounidense sobre cómo podría asociarse con empresas de una manera que respete sus principios éticos.

Considera que hay un largo camino por recorrer antes de que el Departamento de Defensa logre la confianza que necesita. Un problema consiste en que parte de la redacción de las pautas está abierta a interpretación. Por ejemplo, las pautas afirman: "El departamento tomará medidas previstas para minimizar el sesgo no intencionado en las funciones de IA". ¿Qué pasa con el sesgo intencionado? Eso puede parecer demasiado puntilloso, pero las diferencias en la interpretación dependen de este tipo de detalle.

Controlar el uso de la tecnología militar resulta difícil porque generalmente requiere una autorización de seguridad. Para abordar esto, a Mitchell le gustaría que los contratos del Departamento de Defensa proporcionen a los auditores independientes la autorización necesaria. Y ellos podrían asegurar a las empresas que efectivamente se están siguiendo las pautas. "Los empleados necesitan alguna garantía de que las pautas se interpreta según lo esperado", concluye Mitchell.